‘인공지능’으로 가짜뉴스 잡아낸다

입력 2017.05.09 (10:00)

수정 2017.05.09 (10:07)

읽어주기 기능은 크롬기반의

브라우저에서만 사용하실 수 있습니다.

‘인공지능’으로 가짜뉴스 잡아낸다

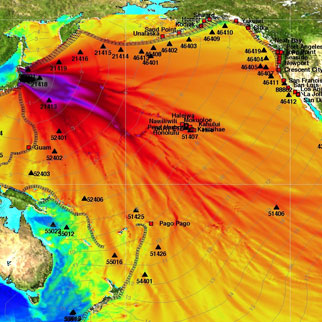

‘후쿠시마 원전 방사능 확산’ 가짜뉴스에 사용된 사진

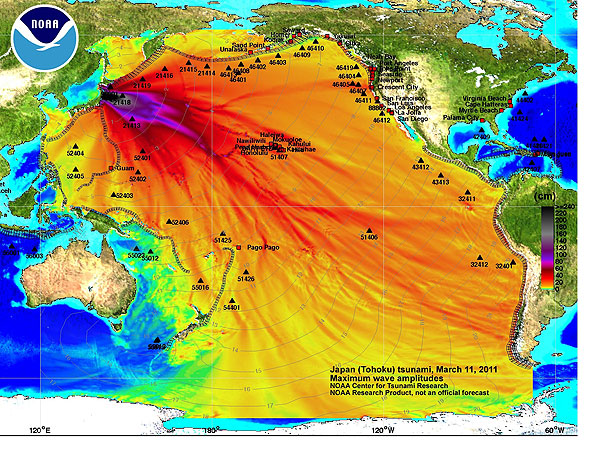

‘후쿠시마 원전 방사능 확산’ 가짜뉴스에 사용된 사진2011년 후쿠시마 원전 사고 이후 방사능에 대한 불안감이 고조됐다. 이듬해 natural news.com 이라는 웹사이트를 통해 “후쿠시마 원전의 방사능이 태평양을 통해 유출되는 경로"라는 가짜뉴스가 위 사진과 함께 전파됐다. 그러나 팩트체크 결과 사실이 아니었다.

2011년 3월 발생한 도호쿠 대지진으로 생긴 쓰나미의 파고 모양이었다. 출처는 국립 해양 대기청이었다.방사능과 무관했다. 그러나 방사능에 대한 불안감에 이 가짜뉴스는 걷잡을 수 없이 확산됐다. 사진 출처를 확인하지 않은 네티즌,기사 내용은 클릭도 하지 않고 제목만 보고 기사를 퍼나른 네티즌들들이 많았다.

가짜뉴스에는 2가지 '의도'가 있다

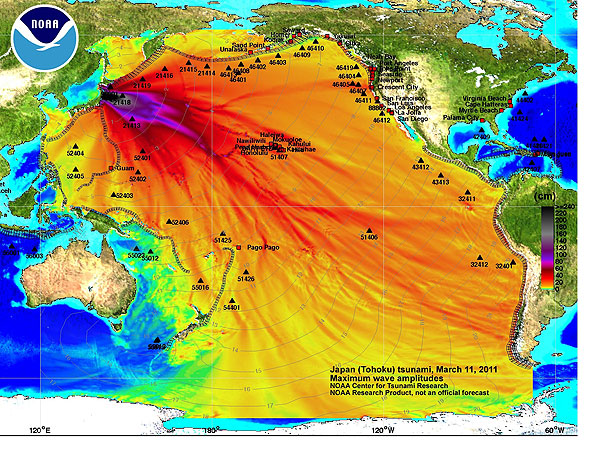

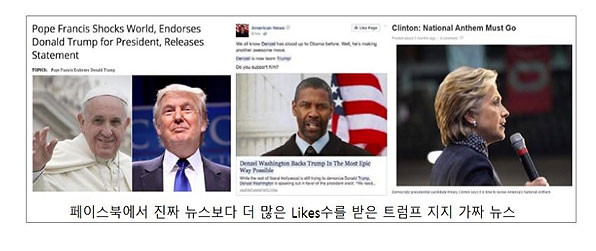

첫 번째는 트래픽을 유도해 상업적인 이익을 취하기 위해서다. 지난해 미국 대선 관련 가짜 뉴스들이 옛 유고슬라비아인 마케도니아의 작은 도시 벨레스에서 발생한 것으로 확인됐다. 공학도인 10대-20대들이 가짜 뉴스사이트를 만들어 페이스북과 트위터 등에서 확산시켜 광고수익을 얻으려 했던 것이다.

두 번째는 정치적 공작이다. 뉴스에 보도된 내용처럼 꾸며 신뢰도를 훔치는 형식이다. 정치적 경쟁 세력 또는 특정 집단을 분리하고 고립시키고자 한다. 이런 의도를 가진 뉴스는 확연히 다른 3가지의 전파 패턴을 갖는 것이 국내 연구진에 의해 확인됐다.

카이스트 차미영 교수와 서울대 정교민 교수연구팀은 지난 2014년부터 최근까지 분산 서버 50대를 연결해 세계 5000만 트위터 사용자가 생산한 20억개 메시지와 20억개 팔로우 링크를 분석한 결과다.

가짜 뉴스는 3가지 '패턴'으로 움직인다.

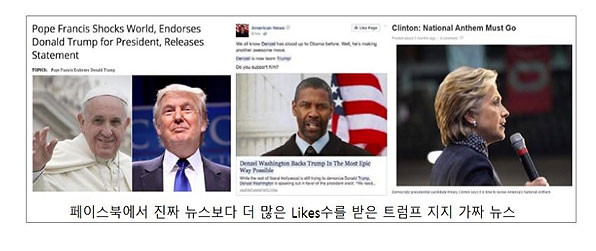

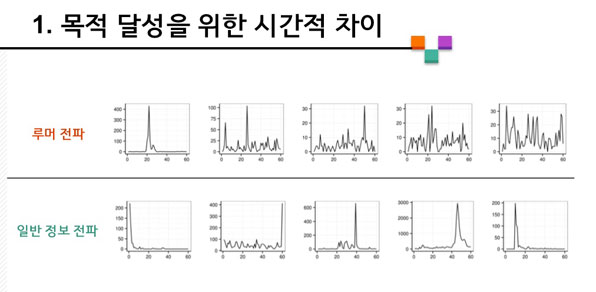

가짜 뉴스는 관심을 갖는 시점이 들쭉날쭉하다. 일반 뉴스가 초기에만 관심도가 높았다 낮아지는 패턴과 대조적이다. 전파자들이 어떤 어젠다를 달성하고자, 광고 수주를 위한 트래픽을 높이려고 인위적인 검색과 댓글이 많다는 얘기다.

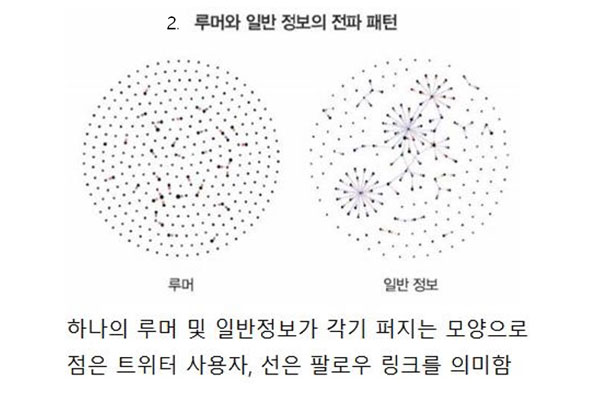

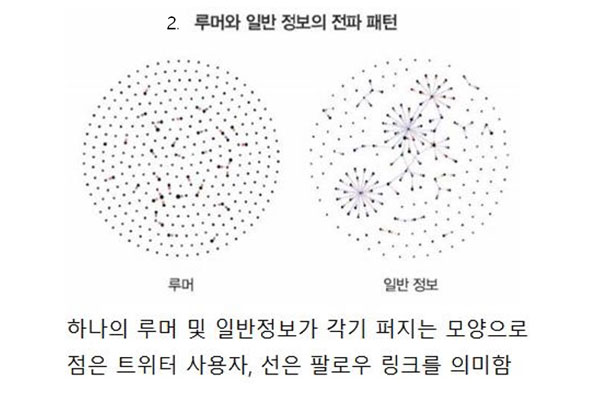

전파자간 구조적 네트워크에서 차이가 난다. 가짜뉴스는 연관이 없는 임의의 사용자가 산발적으 로 참여해 전파가 이뤄졌다. '점' 조직이다. 연결성이 낮고 '선'조직을 이루지 못한다. 팔로워들이 많은 네티즌이 호응하는 비율이 낮고 초기부터 연결성이 적은 사람들을 통해서 전파된다는 의미다.

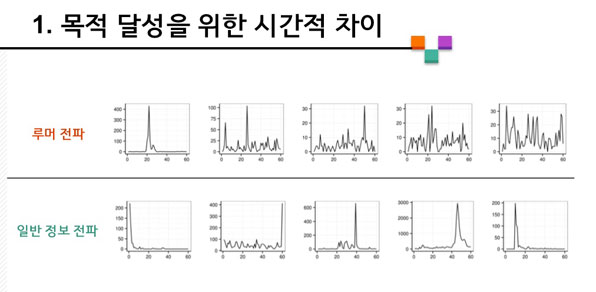

가짜 뉴스는 특별한 언어적 특징을 동반하며 전파된다. "어디서 들었는데”, “확실치는 않지만”, “루머 일 수도 있지만”하는 책임회피성 언어를 사용한다. 이런 언어적 패턴은 컴퓨터 알고리즘을 통해 분석 가능하다. 시간.구조적 전파패턴의 경우 각각의 수학적 모형을 만든 뒤 어떤 모형에 가까운 지를 수치화함으로써 분석 가능하다.바로 이 지점에서 빅데이터분석과 딥러밍이 결합된 인공지능이 등장한다. 목표는 '실시간으로 가짜뉴스를 판별하는 기술'개발이다.

인공지능으로 가짜뉴스 판별...문제는 '골든타임'

카이스트-서울대의 공동연구는 2014년 시작됐다. 트위터의 3년 반 치 데이터를 수집했다. 이를 기반으로 가짜뉴스의 패턴을 모형화하는 데까지 성공했다. 이 모형화된 알고리즘에 과거의 가짜뉴스를 집어넣었더니 90%의 정확도로 '가짜'임을 판단했다.

같은 과거의 가짜뉴스를 인간에게 판단하라고 했을 때는 평균 66%의 정확도였다고 한다. 이렇게 정확도가 높은 것은 인간이 메시지만을 보는 반면 인공지능은 메시지의 이면을 보기 때문이다. 즉 다양한 '전파 패턴'을 포착해낸다. 문제는 시간이다. 실시간 판별이 되야 쓸모가 있다.

그러나 2008년 대선 당시 '버락 오바마는 무슬림이다'라는 가짜 뉴스를 인공지능이 판단하기 위해서는 2달 치의 데이터 분석이 필요했다. 딥러닝을 통해 시간은 단축되고 있다. 최근 '3차 세계대전이 오늘 일어날 것이다'라는 가짜 뉴스는 2~3시간 분량의 데이터 분석을 통해 가짜 뉴스임을 판별해 냈다.

3차 세계대전 가짜뉴스

3차 세계대전 가짜뉴스연구팀은 머지 않아 수백만 건 의 루머나 가짜뉴스를 더욱 빠르게 판단해낼 수 있을 것으로 기대하고 있다. 인간이 일일이 정보를 검열할 수 없을 정도의 방대한 데이터가 매일 생성되고 빠르게 전파되기 때문에 이 데이터만 확보할 수 있다면 가능하다고 보는 것이다.새롭게 광범위하게 전파된 정보가 있을 때 시간적, 구조적, 언어적 특징을 입력해 몇 초 안에 가짜뉴스를 탐지해내는 것이 핵심이다.

가짜 뉴스 탐지에도 골든 타임이 있고, 한번 네트워크를 통해 전파되기 시작한 정보는 통제가 불가능하기 때문이다. 엉뚱한 의도를 가지고 가짜뉴스를 만들려고 했던 사람들이 이 인공지능이 무서워 아예 처음부터 가짜 뉴스 만들기를 포기하는 날도 오지 않을까?

■ 제보하기

▷ 카카오톡 : 'KBS제보' 검색, 채널 추가

▷ 전화 : 02-781-1234, 4444

▷ 이메일 : kbs1234@kbs.co.kr

▷ 유튜브, 네이버, 카카오에서도 KBS뉴스를 구독해주세요!

- ‘인공지능’으로 가짜뉴스 잡아낸다

-

- 입력 2017-05-09 10:00:47

- 수정2017-05-09 10:07:07

2011년 후쿠시마 원전 사고 이후 방사능에 대한 불안감이 고조됐다. 이듬해 natural news.com 이라는 웹사이트를 통해 “후쿠시마 원전의 방사능이 태평양을 통해 유출되는 경로"라는 가짜뉴스가 위 사진과 함께 전파됐다. 그러나 팩트체크 결과 사실이 아니었다.

2011년 3월 발생한 도호쿠 대지진으로 생긴 쓰나미의 파고 모양이었다. 출처는 국립 해양 대기청이었다.방사능과 무관했다. 그러나 방사능에 대한 불안감에 이 가짜뉴스는 걷잡을 수 없이 확산됐다. 사진 출처를 확인하지 않은 네티즌,기사 내용은 클릭도 하지 않고 제목만 보고 기사를 퍼나른 네티즌들들이 많았다.

가짜뉴스에는 2가지 '의도'가 있다

2011년 후쿠시마 원전 사고 이후 방사능에 대한 불안감이 고조됐다. 이듬해 natural news.com 이라는 웹사이트를 통해 “후쿠시마 원전의 방사능이 태평양을 통해 유출되는 경로"라는 가짜뉴스가 위 사진과 함께 전파됐다. 그러나 팩트체크 결과 사실이 아니었다.

2011년 3월 발생한 도호쿠 대지진으로 생긴 쓰나미의 파고 모양이었다. 출처는 국립 해양 대기청이었다.방사능과 무관했다. 그러나 방사능에 대한 불안감에 이 가짜뉴스는 걷잡을 수 없이 확산됐다. 사진 출처를 확인하지 않은 네티즌,기사 내용은 클릭도 하지 않고 제목만 보고 기사를 퍼나른 네티즌들들이 많았다.

가짜뉴스에는 2가지 '의도'가 있다

첫 번째는 트래픽을 유도해 상업적인 이익을 취하기 위해서다. 지난해 미국 대선 관련 가짜 뉴스들이 옛 유고슬라비아인 마케도니아의 작은 도시 벨레스에서 발생한 것으로 확인됐다. 공학도인 10대-20대들이 가짜 뉴스사이트를 만들어 페이스북과 트위터 등에서 확산시켜 광고수익을 얻으려 했던 것이다.

두 번째는 정치적 공작이다. 뉴스에 보도된 내용처럼 꾸며 신뢰도를 훔치는 형식이다. 정치적 경쟁 세력 또는 특정 집단을 분리하고 고립시키고자 한다. 이런 의도를 가진 뉴스는 확연히 다른 3가지의 전파 패턴을 갖는 것이 국내 연구진에 의해 확인됐다.

카이스트 차미영 교수와 서울대 정교민 교수연구팀은 지난 2014년부터 최근까지 분산 서버 50대를 연결해 세계 5000만 트위터 사용자가 생산한 20억개 메시지와 20억개 팔로우 링크를 분석한 결과다.

가짜 뉴스는 3가지 '패턴'으로 움직인다.

첫 번째는 트래픽을 유도해 상업적인 이익을 취하기 위해서다. 지난해 미국 대선 관련 가짜 뉴스들이 옛 유고슬라비아인 마케도니아의 작은 도시 벨레스에서 발생한 것으로 확인됐다. 공학도인 10대-20대들이 가짜 뉴스사이트를 만들어 페이스북과 트위터 등에서 확산시켜 광고수익을 얻으려 했던 것이다.

두 번째는 정치적 공작이다. 뉴스에 보도된 내용처럼 꾸며 신뢰도를 훔치는 형식이다. 정치적 경쟁 세력 또는 특정 집단을 분리하고 고립시키고자 한다. 이런 의도를 가진 뉴스는 확연히 다른 3가지의 전파 패턴을 갖는 것이 국내 연구진에 의해 확인됐다.

카이스트 차미영 교수와 서울대 정교민 교수연구팀은 지난 2014년부터 최근까지 분산 서버 50대를 연결해 세계 5000만 트위터 사용자가 생산한 20억개 메시지와 20억개 팔로우 링크를 분석한 결과다.

가짜 뉴스는 3가지 '패턴'으로 움직인다.

가짜 뉴스는 관심을 갖는 시점이 들쭉날쭉하다. 일반 뉴스가 초기에만 관심도가 높았다 낮아지는 패턴과 대조적이다. 전파자들이 어떤 어젠다를 달성하고자, 광고 수주를 위한 트래픽을 높이려고 인위적인 검색과 댓글이 많다는 얘기다.

가짜 뉴스는 관심을 갖는 시점이 들쭉날쭉하다. 일반 뉴스가 초기에만 관심도가 높았다 낮아지는 패턴과 대조적이다. 전파자들이 어떤 어젠다를 달성하고자, 광고 수주를 위한 트래픽을 높이려고 인위적인 검색과 댓글이 많다는 얘기다.

전파자간 구조적 네트워크에서 차이가 난다. 가짜뉴스는 연관이 없는 임의의 사용자가 산발적으 로 참여해 전파가 이뤄졌다. '점' 조직이다. 연결성이 낮고 '선'조직을 이루지 못한다. 팔로워들이 많은 네티즌이 호응하는 비율이 낮고 초기부터 연결성이 적은 사람들을 통해서 전파된다는 의미다.

전파자간 구조적 네트워크에서 차이가 난다. 가짜뉴스는 연관이 없는 임의의 사용자가 산발적으 로 참여해 전파가 이뤄졌다. '점' 조직이다. 연결성이 낮고 '선'조직을 이루지 못한다. 팔로워들이 많은 네티즌이 호응하는 비율이 낮고 초기부터 연결성이 적은 사람들을 통해서 전파된다는 의미다.

가짜 뉴스는 특별한 언어적 특징을 동반하며 전파된다. "어디서 들었는데”, “확실치는 않지만”, “루머 일 수도 있지만”하는 책임회피성 언어를 사용한다. 이런 언어적 패턴은 컴퓨터 알고리즘을 통해 분석 가능하다. 시간.구조적 전파패턴의 경우 각각의 수학적 모형을 만든 뒤 어떤 모형에 가까운 지를 수치화함으로써 분석 가능하다.바로 이 지점에서 빅데이터분석과 딥러밍이 결합된 인공지능이 등장한다. 목표는 '실시간으로 가짜뉴스를 판별하는 기술'개발이다.

인공지능으로 가짜뉴스 판별...문제는 '골든타임'

카이스트-서울대의 공동연구는 2014년 시작됐다. 트위터의 3년 반 치 데이터를 수집했다. 이를 기반으로 가짜뉴스의 패턴을 모형화하는 데까지 성공했다. 이 모형화된 알고리즘에 과거의 가짜뉴스를 집어넣었더니 90%의 정확도로 '가짜'임을 판단했다.

같은 과거의 가짜뉴스를 인간에게 판단하라고 했을 때는 평균 66%의 정확도였다고 한다. 이렇게 정확도가 높은 것은 인간이 메시지만을 보는 반면 인공지능은 메시지의 이면을 보기 때문이다. 즉 다양한 '전파 패턴'을 포착해낸다. 문제는 시간이다. 실시간 판별이 되야 쓸모가 있다.

그러나 2008년 대선 당시 '버락 오바마는 무슬림이다'라는 가짜 뉴스를 인공지능이 판단하기 위해서는 2달 치의 데이터 분석이 필요했다. 딥러닝을 통해 시간은 단축되고 있다. 최근 '3차 세계대전이 오늘 일어날 것이다'라는 가짜 뉴스는 2~3시간 분량의 데이터 분석을 통해 가짜 뉴스임을 판별해 냈다.

가짜 뉴스는 특별한 언어적 특징을 동반하며 전파된다. "어디서 들었는데”, “확실치는 않지만”, “루머 일 수도 있지만”하는 책임회피성 언어를 사용한다. 이런 언어적 패턴은 컴퓨터 알고리즘을 통해 분석 가능하다. 시간.구조적 전파패턴의 경우 각각의 수학적 모형을 만든 뒤 어떤 모형에 가까운 지를 수치화함으로써 분석 가능하다.바로 이 지점에서 빅데이터분석과 딥러밍이 결합된 인공지능이 등장한다. 목표는 '실시간으로 가짜뉴스를 판별하는 기술'개발이다.

인공지능으로 가짜뉴스 판별...문제는 '골든타임'

카이스트-서울대의 공동연구는 2014년 시작됐다. 트위터의 3년 반 치 데이터를 수집했다. 이를 기반으로 가짜뉴스의 패턴을 모형화하는 데까지 성공했다. 이 모형화된 알고리즘에 과거의 가짜뉴스를 집어넣었더니 90%의 정확도로 '가짜'임을 판단했다.

같은 과거의 가짜뉴스를 인간에게 판단하라고 했을 때는 평균 66%의 정확도였다고 한다. 이렇게 정확도가 높은 것은 인간이 메시지만을 보는 반면 인공지능은 메시지의 이면을 보기 때문이다. 즉 다양한 '전파 패턴'을 포착해낸다. 문제는 시간이다. 실시간 판별이 되야 쓸모가 있다.

그러나 2008년 대선 당시 '버락 오바마는 무슬림이다'라는 가짜 뉴스를 인공지능이 판단하기 위해서는 2달 치의 데이터 분석이 필요했다. 딥러닝을 통해 시간은 단축되고 있다. 최근 '3차 세계대전이 오늘 일어날 것이다'라는 가짜 뉴스는 2~3시간 분량의 데이터 분석을 통해 가짜 뉴스임을 판별해 냈다.

연구팀은 머지 않아 수백만 건 의 루머나 가짜뉴스를 더욱 빠르게 판단해낼 수 있을 것으로 기대하고 있다. 인간이 일일이 정보를 검열할 수 없을 정도의 방대한 데이터가 매일 생성되고 빠르게 전파되기 때문에 이 데이터만 확보할 수 있다면 가능하다고 보는 것이다.새롭게 광범위하게 전파된 정보가 있을 때 시간적, 구조적, 언어적 특징을 입력해 몇 초 안에 가짜뉴스를 탐지해내는 것이 핵심이다.

가짜 뉴스 탐지에도 골든 타임이 있고, 한번 네트워크를 통해 전파되기 시작한 정보는 통제가 불가능하기 때문이다. 엉뚱한 의도를 가지고 가짜뉴스를 만들려고 했던 사람들이 이 인공지능이 무서워 아예 처음부터 가짜 뉴스 만들기를 포기하는 날도 오지 않을까?

연구팀은 머지 않아 수백만 건 의 루머나 가짜뉴스를 더욱 빠르게 판단해낼 수 있을 것으로 기대하고 있다. 인간이 일일이 정보를 검열할 수 없을 정도의 방대한 데이터가 매일 생성되고 빠르게 전파되기 때문에 이 데이터만 확보할 수 있다면 가능하다고 보는 것이다.새롭게 광범위하게 전파된 정보가 있을 때 시간적, 구조적, 언어적 특징을 입력해 몇 초 안에 가짜뉴스를 탐지해내는 것이 핵심이다.

가짜 뉴스 탐지에도 골든 타임이 있고, 한번 네트워크를 통해 전파되기 시작한 정보는 통제가 불가능하기 때문이다. 엉뚱한 의도를 가지고 가짜뉴스를 만들려고 했던 사람들이 이 인공지능이 무서워 아예 처음부터 가짜 뉴스 만들기를 포기하는 날도 오지 않을까?

-

-

최선중 기자 best-ing@kbs.co.kr

최선중 기자의 기사 모음

-

이 기사가 좋으셨다면

-

좋아요

0

-

응원해요

0

-

후속 원해요

0

![[속보] 정성호 법무장관 후보자 “검찰 해체 표현 적절치 않아…국민 눈높이 맞는 개혁 이뤄야”](/data/layer/904/2025/07/20250701_86evyp.png)

이 기사에 대한 의견을 남겨주세요.