영상 속 우는 딸, 알고보니 ‘딥페이크’…납치 상황? 무조건 신고부터

입력 2024.11.07 (17:04)

읽어주기 기능은 크롬기반의

브라우저에서만 사용하실 수 있습니다.

수 초 만에 목소리를 복제해 내는 '딥보이스'. 기술의 비약적인 발전으로 탄생했지만, 동시에 피해자의 목소리로 변조돼 타인의 돈을 뜯으려는 시도가 확인되면서 수사 당국이 주의를 요청한 바 있습니다.

그리고 최근엔 국내에서 이 딥보이스를 넘어, 가짜 영상을 만들어내는 '딥페이크' 영상으로 보이스피싱을 시도한 사례가 확인됐습니다.

■ 영상에서 '우는 딸'…확인해 보니 '딥페이크'

지난달 말, 한 중국인 부모에게 19초짜리 영상이 수신됐습니다.

이 영상에는, 제주도를 여행 중이라는 딸 A 씨가 손발이 묶인 채 울고 있는 모습이 담겨있었습니다.

영상을 확인한 부모는 이 사실을 영사관에 알렸고 이에 제주서부경찰서는 A 씨에 대한 긴급 수색에 나섰습니다. 다행히 A 씨는 당초 예정대로 제주도를 여행 중이었습니다.

이후 경찰청은 이 영상에 대해 탐지 프로그램을 통해, 딥페이크 기술이 사용된 사실을 확인했습니다.

해당 영상은 우리가 흔히 생각하는 조악한 '짜깁기 영상'이 아니었습니다. 중국어로 '살려달라'고 외치며 우는 모습이 담겼는데 한국 경찰과 중국 공안도 실제 영상으로 생각할 수 있는 수준이었습니다.

빠른 신고와 수색 덕에 실제 피해는 발생하지 않았지만, 딥페이크 영상이 납치를 빙자한 범행에 사용될 수 있단 우려가 현실이 되고 있는 겁니다.

■ 올해 '납치 빙자 보이스피싱'만 174건

'너의 가족을 납치했다'는 취지의 거짓말로 돈을 뜯는, 이른바 납치 빙자 전화금융사기 사건은 수사 당국의 적극적인 노력으로 줄어드는 추세이긴 합니다.

올해 9월까지 발생한 납치 빙자 전화금융사기 사건은 174건이었습니다. 지난해 같은 기간 248건이었던 것에 비하면 약 30% 정도 줄어든 수치입니다. 다만 경찰은 이 같은 기술의 발전이 악용된 사례들이 다시 늘어날까, 우려하고 있습니다.

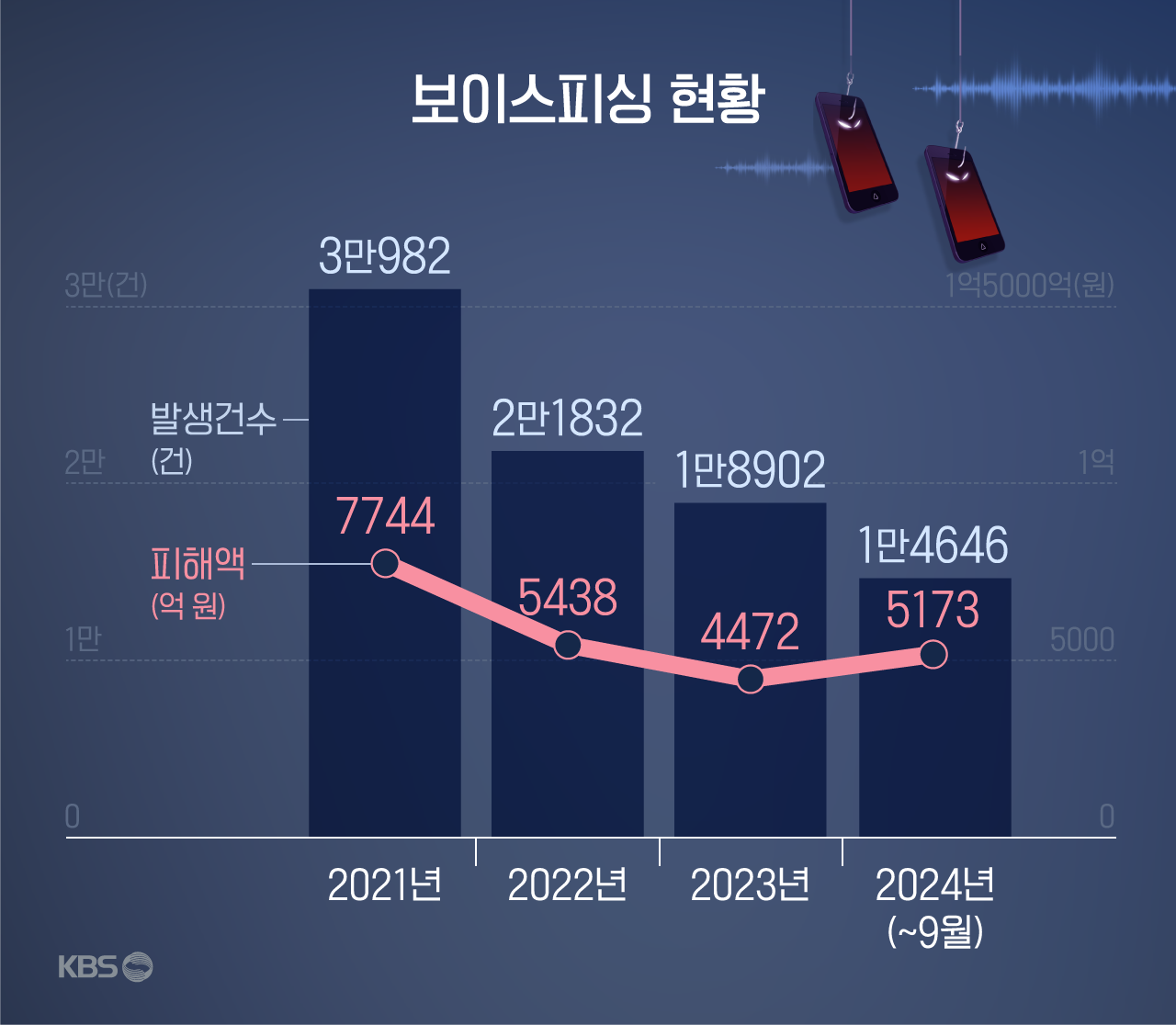

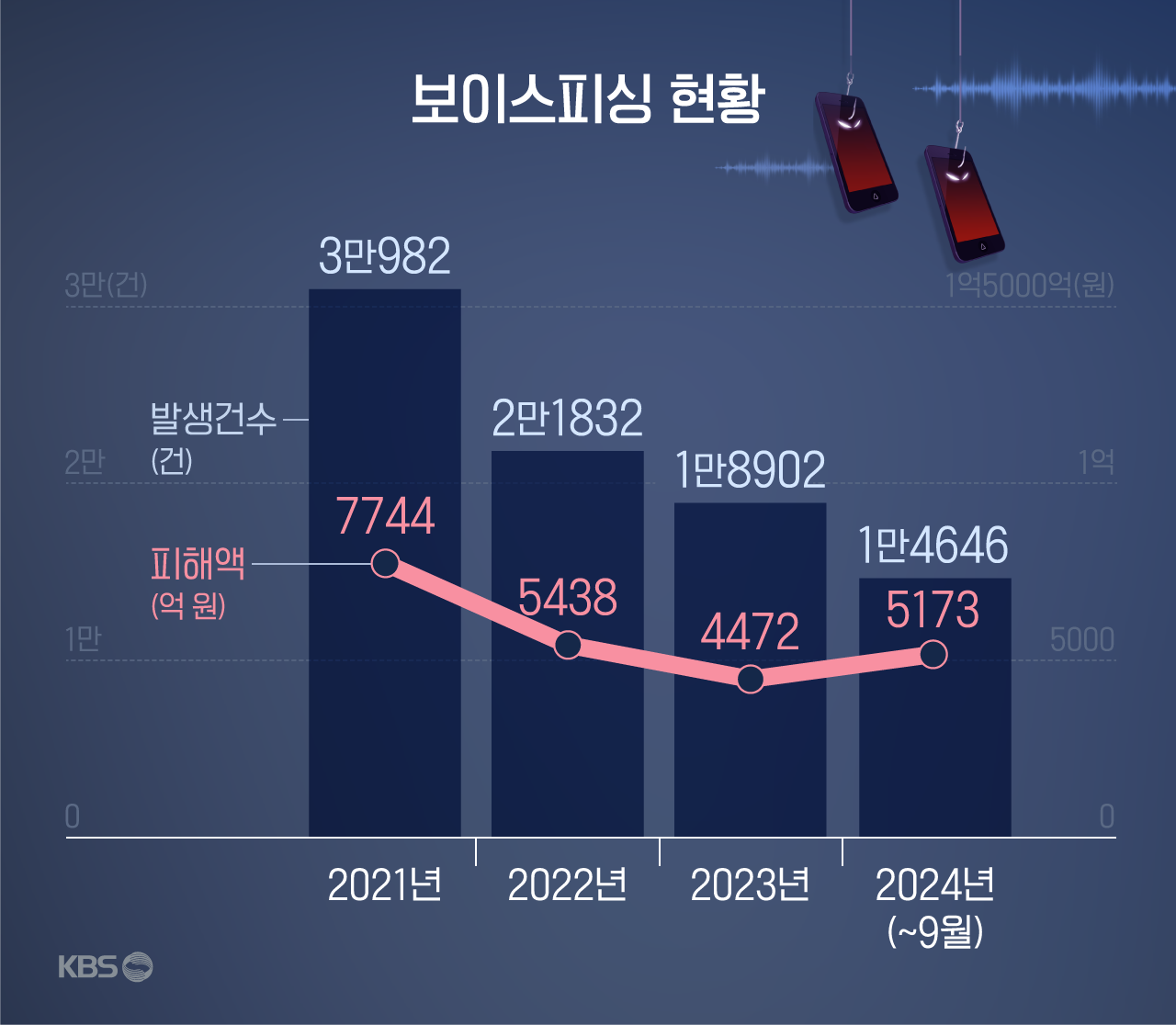

또 보이스피싱 범죄 유형 전체로 보면, 건수의 증감과 관계없이 피해액은 큰 변화 없는 모습을 보이고 있습니다.

지난해 내려앉는 모습을 보였던 보이스피싱 피해액은 되려 올해 다시 늘어났습니다. 지난 9월까지 피해액이 5,173억 원인데 연말까지 합쳐지면 2022년보다도 늘어날 수 있는 겁니다.

보이스피싱 범죄에 대한 대비가 제법 익숙해졌다 싶더라도, 계속해서 주의가 필요한 이유입니다.

■ "납치가 실제이든 아니든 무조건 신고부터 해야"

경찰은 일단 무조건 신고할 것을 강조합니다. 납치가 실제로 이뤄졌든, 납치를 가장한 전화금융사기이든 관계없이 말입니다.

보이스피싱인지 여부와 관계없이 납치 신고가 접수되면 A 씨 사례처럼, 위치 파악 등 초동 조치를 우선으로 하기 때문에 안전 확보와 금전 피해의 목적을 이룰 수 있기 때문입니다.

범인이 전화를 끊지 못하도록 협박해 신고하기 곤란한 경우에는 주변 사람에게 경찰에 신고하도록 도움을 청하거나, 통화하면서 문자메시지로 112에 신고할 것을 권고합니다.

동시에 경찰은 기술이 악용된 '창'에 대한 '방패'도 고안하고 있습니다.

딥러닝 기반 허위 조작 콘텐츠 탐지 기술 개발에 내년 27억 원을 시작으로 2027년까지 3년 동안 모두 91억 원을 투입하고, 최신 인공지능 기법을 활용한 허위 영상물을 탐지할 수 있도록 관련 소프트웨어 고도화에 5억 원을 편성했습니다.

하지만 그사이 존재하는 '시차'에 대비하려면, 의심하고 차단하며 신고하는 예방법을 숙지해 둘 필요가 있어 보입니다.

■ 제보하기

▷ 카카오톡 : 'KBS제보' 검색, 채널 추가

▷ 전화 : 02-781-1234, 4444

▷ 이메일 : kbs1234@kbs.co.kr

▷ 유튜브, 네이버, 카카오에서도 KBS뉴스를 구독해주세요!

- 영상 속 우는 딸, 알고보니 ‘딥페이크’…납치 상황? 무조건 신고부터

-

- 입력 2024-11-07 17:04:31

수 초 만에 목소리를 복제해 내는 '딥보이스'. 기술의 비약적인 발전으로 탄생했지만, 동시에 피해자의 목소리로 변조돼 타인의 돈을 뜯으려는 시도가 확인되면서 수사 당국이 주의를 요청한 바 있습니다.

그리고 최근엔 국내에서 이 딥보이스를 넘어, 가짜 영상을 만들어내는 '딥페이크' 영상으로 보이스피싱을 시도한 사례가 확인됐습니다.

■ 영상에서 '우는 딸'…확인해 보니 '딥페이크'

지난달 말, 한 중국인 부모에게 19초짜리 영상이 수신됐습니다.

이 영상에는, 제주도를 여행 중이라는 딸 A 씨가 손발이 묶인 채 울고 있는 모습이 담겨있었습니다.

영상을 확인한 부모는 이 사실을 영사관에 알렸고 이에 제주서부경찰서는 A 씨에 대한 긴급 수색에 나섰습니다. 다행히 A 씨는 당초 예정대로 제주도를 여행 중이었습니다.

이후 경찰청은 이 영상에 대해 탐지 프로그램을 통해, 딥페이크 기술이 사용된 사실을 확인했습니다.

해당 영상은 우리가 흔히 생각하는 조악한 '짜깁기 영상'이 아니었습니다. 중국어로 '살려달라'고 외치며 우는 모습이 담겼는데 한국 경찰과 중국 공안도 실제 영상으로 생각할 수 있는 수준이었습니다.

빠른 신고와 수색 덕에 실제 피해는 발생하지 않았지만, 딥페이크 영상이 납치를 빙자한 범행에 사용될 수 있단 우려가 현실이 되고 있는 겁니다.

■ 올해 '납치 빙자 보이스피싱'만 174건

'너의 가족을 납치했다'는 취지의 거짓말로 돈을 뜯는, 이른바 납치 빙자 전화금융사기 사건은 수사 당국의 적극적인 노력으로 줄어드는 추세이긴 합니다.

올해 9월까지 발생한 납치 빙자 전화금융사기 사건은 174건이었습니다. 지난해 같은 기간 248건이었던 것에 비하면 약 30% 정도 줄어든 수치입니다. 다만 경찰은 이 같은 기술의 발전이 악용된 사례들이 다시 늘어날까, 우려하고 있습니다.

또 보이스피싱 범죄 유형 전체로 보면, 건수의 증감과 관계없이 피해액은 큰 변화 없는 모습을 보이고 있습니다.

지난해 내려앉는 모습을 보였던 보이스피싱 피해액은 되려 올해 다시 늘어났습니다. 지난 9월까지 피해액이 5,173억 원인데 연말까지 합쳐지면 2022년보다도 늘어날 수 있는 겁니다.

보이스피싱 범죄에 대한 대비가 제법 익숙해졌다 싶더라도, 계속해서 주의가 필요한 이유입니다.

■ "납치가 실제이든 아니든 무조건 신고부터 해야"

경찰은 일단 무조건 신고할 것을 강조합니다. 납치가 실제로 이뤄졌든, 납치를 가장한 전화금융사기이든 관계없이 말입니다.

보이스피싱인지 여부와 관계없이 납치 신고가 접수되면 A 씨 사례처럼, 위치 파악 등 초동 조치를 우선으로 하기 때문에 안전 확보와 금전 피해의 목적을 이룰 수 있기 때문입니다.

범인이 전화를 끊지 못하도록 협박해 신고하기 곤란한 경우에는 주변 사람에게 경찰에 신고하도록 도움을 청하거나, 통화하면서 문자메시지로 112에 신고할 것을 권고합니다.

동시에 경찰은 기술이 악용된 '창'에 대한 '방패'도 고안하고 있습니다.

딥러닝 기반 허위 조작 콘텐츠 탐지 기술 개발에 내년 27억 원을 시작으로 2027년까지 3년 동안 모두 91억 원을 투입하고, 최신 인공지능 기법을 활용한 허위 영상물을 탐지할 수 있도록 관련 소프트웨어 고도화에 5억 원을 편성했습니다.

하지만 그사이 존재하는 '시차'에 대비하려면, 의심하고 차단하며 신고하는 예방법을 숙지해 둘 필요가 있어 보입니다.

-

-

우한솔 기자 pine@kbs.co.kr

우한솔 기자의 기사 모음

-

이 기사가 좋으셨다면

-

좋아요

0

-

응원해요

0

-

후속 원해요

0

이 기사에 대한 의견을 남겨주세요.