[ET] “톰 크루즈 맞는데…아니라고?” 진짜 넘보는 가짜 ‘딥페이크’

입력 2021.05.31 (18:05)

수정 2021.05.31 (19:29)

읽어주기 기능은 크롬기반의

브라우저에서만 사용하실 수 있습니다.

[앵커]

최근 국가정보원이 '딥페이크' 사기 주의보를 내렸습니다.

오늘은 딥페이크가 뭔지, 또 이걸 왜 국정원이 신경 쓰는지, <글로벌 ET> 서영민 기자와 자세한 얘기 나눠봅니다.

'딥페이크' 이게 뭔지부터 알고 가야겠죠?

[기자]

백문이 불여일견, 영상 하나 보고 시작하시죠.

["안녕하세요, 일론 머스크입니다. 반갑습니다. 저 따라서 비트코인 했다가 피 본 사람 많죠? 나는 돈이 많으니까 상관없는데, 여러분은 조심하셔야 해. 암튼, 테슬라 주식 얼른 사. 화성 갈 거니까!"]

[앵커]

이 사람, '일론 머스크' 아닌가요?

아니, 언제 한국말을 배웠죠?

머스크 아니죠?

[기자]

약간 어눌하긴 하지만 그래도 외국인이 했다기엔 너무 유창한 한국말, 그것도 전라도 사투리를 진짜 했을 리는 없겠죠.

'딥페이크' 인공지능 AI로 다른 사람의 얼굴과 목소리를 합성하는 걸 말합니다.

하지만 이 영상은 화질도 그렇고 입술 움직임도 그렇고 정교하진 않습니다.

웃자고 만든 영상이기 때문이고, 아주 초보적인 딥페이크가 적용된, 한 국내 유튜브 채널이 만들어 요즘 화제가 되는 풍자 영상입니다.

진짜는 이렇게 허술하지 않습니다.

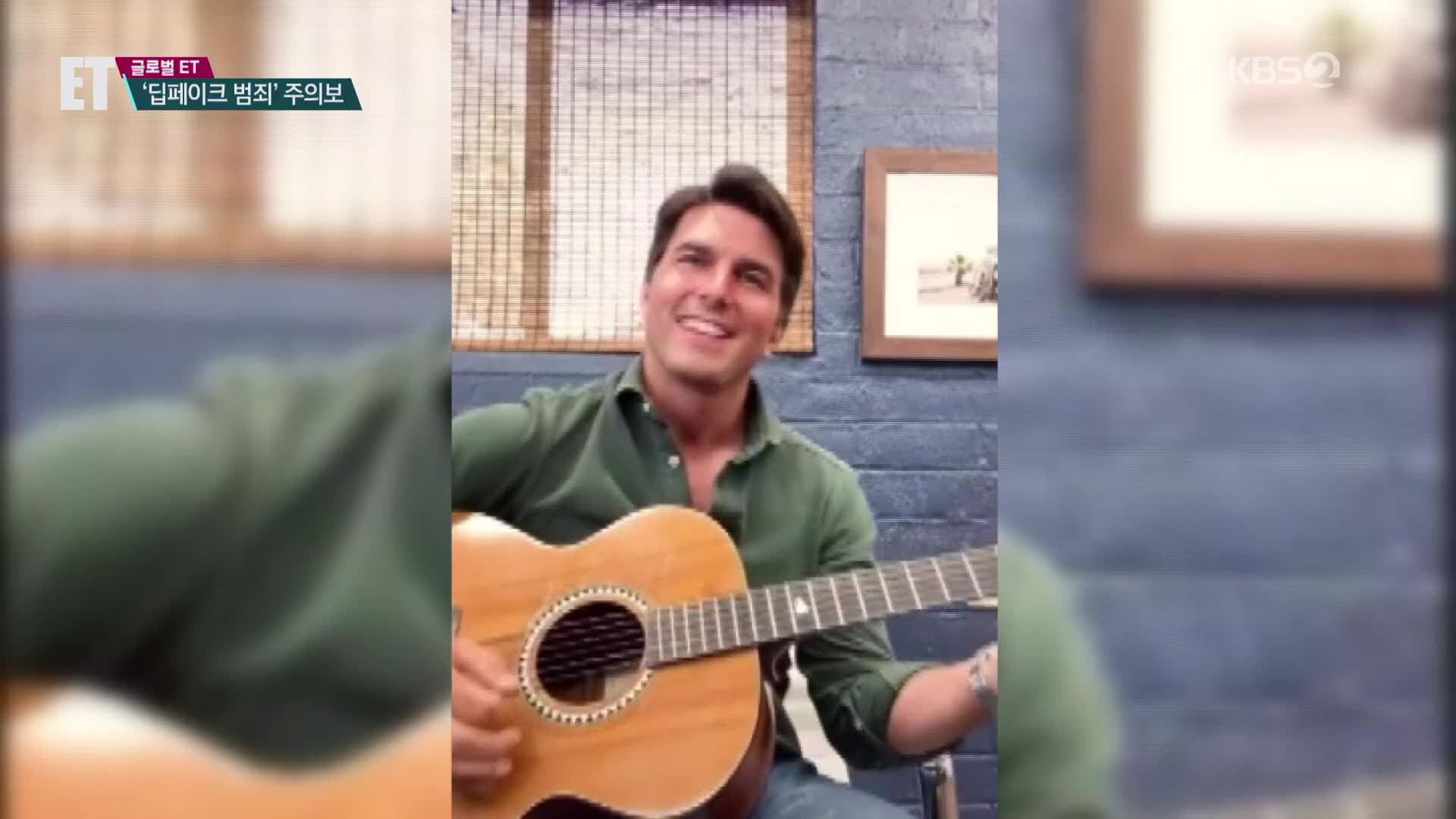

미국 할리우드 배우, 톰 크루즈입니다.

능숙하게 골프도 치고요.

동전을 이용한 마술도 보여줍니다.

기타 연주도 수준급입니다.

["천사 같아요."]

이 영상을 본 사람들, '톰 크루즈'로 확신하며 '좋아요' 눌렀는데, 알고 보니 가짜였습니다.

역시 '딥페이크'를 활용했습니다.

최근 만들어진 오바마, 트럼프 등 전직 미국 대통령 영상, 그리고 영국 엘리자베스 여왕까지 딥페이크는 주로 유명인들을 대상으로 하는데요.

AI 기술이 고도화하고 더 정교해지면서, 이제는 가짜를 눈치채지 못할 정도로 실제와 비슷한 영상이 만들어지고 있습니다.

[앵커]

우리나라 사람 딥페이크는 없나요?

[기자]

있습니다.

화면 하나 보실까요?

이건 인기 걸그룹 블랙핑크 딥페이크 영상인데요.

가짜인지 아시겠나요?

유튜브나 틱톡 같은 SNS에 요즘 진짜 같은 연예인 딥페이크가 넘쳐납니다.

아이유는 중국의 한 크리에이터의 영상이 유명한데 사람들이 '차이유'라고도 부르기도 한다는데, 실물이 공개되며 딥페이크 논란에 휩싸이기도 했습니다.

[앵커]

이게 어떻게 다른 곳도 아니고 국정원이 신경 쓸 정도의 범죄와 관련이 될 수 있죠?

[기자]

우선은 성범죄입니다.

특정 불법 음란물 영상에 유명인을 합성 하는 거죠.

한 조사에 따르면 2019년에 올라온 '딥페이크' 영상 가운데 96%가 '불법 음란물'로, 피해자 중에는 미국·영국 여배우가 가장 많았지만, 25%는 K팝 가수 등 한국 여성 연예인이었습니다.

[앵커]

일반인들은 무관한 거 아닌가요 그럼?

[기자]

아닙니다.

오히려 범죄의 가능성으로 보면 블루오션입니다.

아는 사람의 얼굴을 불법으로 합성해 금전을 갈취하는 범죄에 악용하는 일이 늘고 있습니다.

소셜미디어에 올려둔 사진이나 영상 많잖아요?

몇 개만 있으면 가능합니다.

네가 뭐 했는지 안다, 너와 혹은 너의 가족과 관련된 영상 가지고 있다.

이런 협박, 근데 본인조차 그게 진짠지 아닌지 구별할 수가 없는 거죠.

누구든지 타겟될 수 있고, 누구라도 쉽게 범행 저지를 수 있습니다.

[앵커]

이런 범죄자들 경찰이 실제로 많이 잡았다고요?

[기자]

네, 불법 합성물 제작 및 유포 행위를 집중 수사해 94명을 검거했는데요.

이 가운데 약 90%가 10대와 20대였습니다.

피해자 연령대 역시 10대가 가장 많았습니다.

[앵커]

명백히 '불법'이죠?

[기자]

네, 지난해 6월 처벌 규정도 마련됐습니다.

불법 합성물 제작·유포 행위는 5년 이하의 징역, 돈을 받고 팔 경우 7년까지, 훨씬 무거운 처벌을 받습니다.

그러나 실제로 처벌받는 사례, 극소수입니다.

온라인 범죄라 가해자를 특정하기가 쉽지 않고, 법이 디지털 성범죄 수법을 따라가지 못하는 점도 있고, 다른 한편, '딥페이크'를 '재미'로 소비하는 것도 문제입니다.

스마트폰 하나만으로도 가능하거든요. 요즘은?

특히, 10대 청소년의 경우 타인의 얼굴을 합성하는 행위를 장난으로 생각해 처벌받지 않는다고 생각한다는 조사 결과도 있습니다.

'가짜인 걸 알고 보는데 뭐가 문제가 되냐' 이런 인식인데, 새로운 기술의 도입은 그러나 언제나 그랬듯, 이번에도 범죄자들에겐 좋은 도구가 된다는 점 잊지 말아야 합니다.

[앵커]

'딥페이크' 물론 잘 활용하면 좋은 기술입니다.

영화나 엔터테인먼트 산업에서 실제로 그렇고, 또 그리운 사람의 모습을 똑같이 재현해서 감동을 주기도 합니다.

모쪼록 잘 관리해서 좋은 쪽으로만 발전해가길 기대해봅니다.

잘 들었습니다.

최근 국가정보원이 '딥페이크' 사기 주의보를 내렸습니다.

오늘은 딥페이크가 뭔지, 또 이걸 왜 국정원이 신경 쓰는지, <글로벌 ET> 서영민 기자와 자세한 얘기 나눠봅니다.

'딥페이크' 이게 뭔지부터 알고 가야겠죠?

[기자]

백문이 불여일견, 영상 하나 보고 시작하시죠.

["안녕하세요, 일론 머스크입니다. 반갑습니다. 저 따라서 비트코인 했다가 피 본 사람 많죠? 나는 돈이 많으니까 상관없는데, 여러분은 조심하셔야 해. 암튼, 테슬라 주식 얼른 사. 화성 갈 거니까!"]

[앵커]

이 사람, '일론 머스크' 아닌가요?

아니, 언제 한국말을 배웠죠?

머스크 아니죠?

[기자]

약간 어눌하긴 하지만 그래도 외국인이 했다기엔 너무 유창한 한국말, 그것도 전라도 사투리를 진짜 했을 리는 없겠죠.

'딥페이크' 인공지능 AI로 다른 사람의 얼굴과 목소리를 합성하는 걸 말합니다.

하지만 이 영상은 화질도 그렇고 입술 움직임도 그렇고 정교하진 않습니다.

웃자고 만든 영상이기 때문이고, 아주 초보적인 딥페이크가 적용된, 한 국내 유튜브 채널이 만들어 요즘 화제가 되는 풍자 영상입니다.

진짜는 이렇게 허술하지 않습니다.

미국 할리우드 배우, 톰 크루즈입니다.

능숙하게 골프도 치고요.

동전을 이용한 마술도 보여줍니다.

기타 연주도 수준급입니다.

["천사 같아요."]

이 영상을 본 사람들, '톰 크루즈'로 확신하며 '좋아요' 눌렀는데, 알고 보니 가짜였습니다.

역시 '딥페이크'를 활용했습니다.

최근 만들어진 오바마, 트럼프 등 전직 미국 대통령 영상, 그리고 영국 엘리자베스 여왕까지 딥페이크는 주로 유명인들을 대상으로 하는데요.

AI 기술이 고도화하고 더 정교해지면서, 이제는 가짜를 눈치채지 못할 정도로 실제와 비슷한 영상이 만들어지고 있습니다.

[앵커]

우리나라 사람 딥페이크는 없나요?

[기자]

있습니다.

화면 하나 보실까요?

이건 인기 걸그룹 블랙핑크 딥페이크 영상인데요.

가짜인지 아시겠나요?

유튜브나 틱톡 같은 SNS에 요즘 진짜 같은 연예인 딥페이크가 넘쳐납니다.

아이유는 중국의 한 크리에이터의 영상이 유명한데 사람들이 '차이유'라고도 부르기도 한다는데, 실물이 공개되며 딥페이크 논란에 휩싸이기도 했습니다.

[앵커]

이게 어떻게 다른 곳도 아니고 국정원이 신경 쓸 정도의 범죄와 관련이 될 수 있죠?

[기자]

우선은 성범죄입니다.

특정 불법 음란물 영상에 유명인을 합성 하는 거죠.

한 조사에 따르면 2019년에 올라온 '딥페이크' 영상 가운데 96%가 '불법 음란물'로, 피해자 중에는 미국·영국 여배우가 가장 많았지만, 25%는 K팝 가수 등 한국 여성 연예인이었습니다.

[앵커]

일반인들은 무관한 거 아닌가요 그럼?

[기자]

아닙니다.

오히려 범죄의 가능성으로 보면 블루오션입니다.

아는 사람의 얼굴을 불법으로 합성해 금전을 갈취하는 범죄에 악용하는 일이 늘고 있습니다.

소셜미디어에 올려둔 사진이나 영상 많잖아요?

몇 개만 있으면 가능합니다.

네가 뭐 했는지 안다, 너와 혹은 너의 가족과 관련된 영상 가지고 있다.

이런 협박, 근데 본인조차 그게 진짠지 아닌지 구별할 수가 없는 거죠.

누구든지 타겟될 수 있고, 누구라도 쉽게 범행 저지를 수 있습니다.

[앵커]

이런 범죄자들 경찰이 실제로 많이 잡았다고요?

[기자]

네, 불법 합성물 제작 및 유포 행위를 집중 수사해 94명을 검거했는데요.

이 가운데 약 90%가 10대와 20대였습니다.

피해자 연령대 역시 10대가 가장 많았습니다.

[앵커]

명백히 '불법'이죠?

[기자]

네, 지난해 6월 처벌 규정도 마련됐습니다.

불법 합성물 제작·유포 행위는 5년 이하의 징역, 돈을 받고 팔 경우 7년까지, 훨씬 무거운 처벌을 받습니다.

그러나 실제로 처벌받는 사례, 극소수입니다.

온라인 범죄라 가해자를 특정하기가 쉽지 않고, 법이 디지털 성범죄 수법을 따라가지 못하는 점도 있고, 다른 한편, '딥페이크'를 '재미'로 소비하는 것도 문제입니다.

스마트폰 하나만으로도 가능하거든요. 요즘은?

특히, 10대 청소년의 경우 타인의 얼굴을 합성하는 행위를 장난으로 생각해 처벌받지 않는다고 생각한다는 조사 결과도 있습니다.

'가짜인 걸 알고 보는데 뭐가 문제가 되냐' 이런 인식인데, 새로운 기술의 도입은 그러나 언제나 그랬듯, 이번에도 범죄자들에겐 좋은 도구가 된다는 점 잊지 말아야 합니다.

[앵커]

'딥페이크' 물론 잘 활용하면 좋은 기술입니다.

영화나 엔터테인먼트 산업에서 실제로 그렇고, 또 그리운 사람의 모습을 똑같이 재현해서 감동을 주기도 합니다.

모쪼록 잘 관리해서 좋은 쪽으로만 발전해가길 기대해봅니다.

잘 들었습니다.

■ 제보하기

▷ 카카오톡 : 'KBS제보' 검색, 채널 추가

▷ 전화 : 02-781-1234, 4444

▷ 이메일 : kbs1234@kbs.co.kr

▷ 유튜브, 네이버, 카카오에서도 KBS뉴스를 구독해주세요!

- [ET] “톰 크루즈 맞는데…아니라고?” 진짜 넘보는 가짜 ‘딥페이크’

-

- 입력 2021-05-31 18:05:49

- 수정2021-05-31 19:29:37

[앵커]

최근 국가정보원이 '딥페이크' 사기 주의보를 내렸습니다.

오늘은 딥페이크가 뭔지, 또 이걸 왜 국정원이 신경 쓰는지, <글로벌 ET> 서영민 기자와 자세한 얘기 나눠봅니다.

'딥페이크' 이게 뭔지부터 알고 가야겠죠?

[기자]

백문이 불여일견, 영상 하나 보고 시작하시죠.

["안녕하세요, 일론 머스크입니다. 반갑습니다. 저 따라서 비트코인 했다가 피 본 사람 많죠? 나는 돈이 많으니까 상관없는데, 여러분은 조심하셔야 해. 암튼, 테슬라 주식 얼른 사. 화성 갈 거니까!"]

[앵커]

이 사람, '일론 머스크' 아닌가요?

아니, 언제 한국말을 배웠죠?

머스크 아니죠?

[기자]

약간 어눌하긴 하지만 그래도 외국인이 했다기엔 너무 유창한 한국말, 그것도 전라도 사투리를 진짜 했을 리는 없겠죠.

'딥페이크' 인공지능 AI로 다른 사람의 얼굴과 목소리를 합성하는 걸 말합니다.

하지만 이 영상은 화질도 그렇고 입술 움직임도 그렇고 정교하진 않습니다.

웃자고 만든 영상이기 때문이고, 아주 초보적인 딥페이크가 적용된, 한 국내 유튜브 채널이 만들어 요즘 화제가 되는 풍자 영상입니다.

진짜는 이렇게 허술하지 않습니다.

미국 할리우드 배우, 톰 크루즈입니다.

능숙하게 골프도 치고요.

동전을 이용한 마술도 보여줍니다.

기타 연주도 수준급입니다.

["천사 같아요."]

이 영상을 본 사람들, '톰 크루즈'로 확신하며 '좋아요' 눌렀는데, 알고 보니 가짜였습니다.

역시 '딥페이크'를 활용했습니다.

최근 만들어진 오바마, 트럼프 등 전직 미국 대통령 영상, 그리고 영국 엘리자베스 여왕까지 딥페이크는 주로 유명인들을 대상으로 하는데요.

AI 기술이 고도화하고 더 정교해지면서, 이제는 가짜를 눈치채지 못할 정도로 실제와 비슷한 영상이 만들어지고 있습니다.

[앵커]

우리나라 사람 딥페이크는 없나요?

[기자]

있습니다.

화면 하나 보실까요?

이건 인기 걸그룹 블랙핑크 딥페이크 영상인데요.

가짜인지 아시겠나요?

유튜브나 틱톡 같은 SNS에 요즘 진짜 같은 연예인 딥페이크가 넘쳐납니다.

아이유는 중국의 한 크리에이터의 영상이 유명한데 사람들이 '차이유'라고도 부르기도 한다는데, 실물이 공개되며 딥페이크 논란에 휩싸이기도 했습니다.

[앵커]

이게 어떻게 다른 곳도 아니고 국정원이 신경 쓸 정도의 범죄와 관련이 될 수 있죠?

[기자]

우선은 성범죄입니다.

특정 불법 음란물 영상에 유명인을 합성 하는 거죠.

한 조사에 따르면 2019년에 올라온 '딥페이크' 영상 가운데 96%가 '불법 음란물'로, 피해자 중에는 미국·영국 여배우가 가장 많았지만, 25%는 K팝 가수 등 한국 여성 연예인이었습니다.

[앵커]

일반인들은 무관한 거 아닌가요 그럼?

[기자]

아닙니다.

오히려 범죄의 가능성으로 보면 블루오션입니다.

아는 사람의 얼굴을 불법으로 합성해 금전을 갈취하는 범죄에 악용하는 일이 늘고 있습니다.

소셜미디어에 올려둔 사진이나 영상 많잖아요?

몇 개만 있으면 가능합니다.

네가 뭐 했는지 안다, 너와 혹은 너의 가족과 관련된 영상 가지고 있다.

이런 협박, 근데 본인조차 그게 진짠지 아닌지 구별할 수가 없는 거죠.

누구든지 타겟될 수 있고, 누구라도 쉽게 범행 저지를 수 있습니다.

[앵커]

이런 범죄자들 경찰이 실제로 많이 잡았다고요?

[기자]

네, 불법 합성물 제작 및 유포 행위를 집중 수사해 94명을 검거했는데요.

이 가운데 약 90%가 10대와 20대였습니다.

피해자 연령대 역시 10대가 가장 많았습니다.

[앵커]

명백히 '불법'이죠?

[기자]

네, 지난해 6월 처벌 규정도 마련됐습니다.

불법 합성물 제작·유포 행위는 5년 이하의 징역, 돈을 받고 팔 경우 7년까지, 훨씬 무거운 처벌을 받습니다.

그러나 실제로 처벌받는 사례, 극소수입니다.

온라인 범죄라 가해자를 특정하기가 쉽지 않고, 법이 디지털 성범죄 수법을 따라가지 못하는 점도 있고, 다른 한편, '딥페이크'를 '재미'로 소비하는 것도 문제입니다.

스마트폰 하나만으로도 가능하거든요. 요즘은?

특히, 10대 청소년의 경우 타인의 얼굴을 합성하는 행위를 장난으로 생각해 처벌받지 않는다고 생각한다는 조사 결과도 있습니다.

'가짜인 걸 알고 보는데 뭐가 문제가 되냐' 이런 인식인데, 새로운 기술의 도입은 그러나 언제나 그랬듯, 이번에도 범죄자들에겐 좋은 도구가 된다는 점 잊지 말아야 합니다.

[앵커]

'딥페이크' 물론 잘 활용하면 좋은 기술입니다.

영화나 엔터테인먼트 산업에서 실제로 그렇고, 또 그리운 사람의 모습을 똑같이 재현해서 감동을 주기도 합니다.

모쪼록 잘 관리해서 좋은 쪽으로만 발전해가길 기대해봅니다.

잘 들었습니다.

최근 국가정보원이 '딥페이크' 사기 주의보를 내렸습니다.

오늘은 딥페이크가 뭔지, 또 이걸 왜 국정원이 신경 쓰는지, <글로벌 ET> 서영민 기자와 자세한 얘기 나눠봅니다.

'딥페이크' 이게 뭔지부터 알고 가야겠죠?

[기자]

백문이 불여일견, 영상 하나 보고 시작하시죠.

["안녕하세요, 일론 머스크입니다. 반갑습니다. 저 따라서 비트코인 했다가 피 본 사람 많죠? 나는 돈이 많으니까 상관없는데, 여러분은 조심하셔야 해. 암튼, 테슬라 주식 얼른 사. 화성 갈 거니까!"]

[앵커]

이 사람, '일론 머스크' 아닌가요?

아니, 언제 한국말을 배웠죠?

머스크 아니죠?

[기자]

약간 어눌하긴 하지만 그래도 외국인이 했다기엔 너무 유창한 한국말, 그것도 전라도 사투리를 진짜 했을 리는 없겠죠.

'딥페이크' 인공지능 AI로 다른 사람의 얼굴과 목소리를 합성하는 걸 말합니다.

하지만 이 영상은 화질도 그렇고 입술 움직임도 그렇고 정교하진 않습니다.

웃자고 만든 영상이기 때문이고, 아주 초보적인 딥페이크가 적용된, 한 국내 유튜브 채널이 만들어 요즘 화제가 되는 풍자 영상입니다.

진짜는 이렇게 허술하지 않습니다.

미국 할리우드 배우, 톰 크루즈입니다.

능숙하게 골프도 치고요.

동전을 이용한 마술도 보여줍니다.

기타 연주도 수준급입니다.

["천사 같아요."]

이 영상을 본 사람들, '톰 크루즈'로 확신하며 '좋아요' 눌렀는데, 알고 보니 가짜였습니다.

역시 '딥페이크'를 활용했습니다.

최근 만들어진 오바마, 트럼프 등 전직 미국 대통령 영상, 그리고 영국 엘리자베스 여왕까지 딥페이크는 주로 유명인들을 대상으로 하는데요.

AI 기술이 고도화하고 더 정교해지면서, 이제는 가짜를 눈치채지 못할 정도로 실제와 비슷한 영상이 만들어지고 있습니다.

[앵커]

우리나라 사람 딥페이크는 없나요?

[기자]

있습니다.

화면 하나 보실까요?

이건 인기 걸그룹 블랙핑크 딥페이크 영상인데요.

가짜인지 아시겠나요?

유튜브나 틱톡 같은 SNS에 요즘 진짜 같은 연예인 딥페이크가 넘쳐납니다.

아이유는 중국의 한 크리에이터의 영상이 유명한데 사람들이 '차이유'라고도 부르기도 한다는데, 실물이 공개되며 딥페이크 논란에 휩싸이기도 했습니다.

[앵커]

이게 어떻게 다른 곳도 아니고 국정원이 신경 쓸 정도의 범죄와 관련이 될 수 있죠?

[기자]

우선은 성범죄입니다.

특정 불법 음란물 영상에 유명인을 합성 하는 거죠.

한 조사에 따르면 2019년에 올라온 '딥페이크' 영상 가운데 96%가 '불법 음란물'로, 피해자 중에는 미국·영국 여배우가 가장 많았지만, 25%는 K팝 가수 등 한국 여성 연예인이었습니다.

[앵커]

일반인들은 무관한 거 아닌가요 그럼?

[기자]

아닙니다.

오히려 범죄의 가능성으로 보면 블루오션입니다.

아는 사람의 얼굴을 불법으로 합성해 금전을 갈취하는 범죄에 악용하는 일이 늘고 있습니다.

소셜미디어에 올려둔 사진이나 영상 많잖아요?

몇 개만 있으면 가능합니다.

네가 뭐 했는지 안다, 너와 혹은 너의 가족과 관련된 영상 가지고 있다.

이런 협박, 근데 본인조차 그게 진짠지 아닌지 구별할 수가 없는 거죠.

누구든지 타겟될 수 있고, 누구라도 쉽게 범행 저지를 수 있습니다.

[앵커]

이런 범죄자들 경찰이 실제로 많이 잡았다고요?

[기자]

네, 불법 합성물 제작 및 유포 행위를 집중 수사해 94명을 검거했는데요.

이 가운데 약 90%가 10대와 20대였습니다.

피해자 연령대 역시 10대가 가장 많았습니다.

[앵커]

명백히 '불법'이죠?

[기자]

네, 지난해 6월 처벌 규정도 마련됐습니다.

불법 합성물 제작·유포 행위는 5년 이하의 징역, 돈을 받고 팔 경우 7년까지, 훨씬 무거운 처벌을 받습니다.

그러나 실제로 처벌받는 사례, 극소수입니다.

온라인 범죄라 가해자를 특정하기가 쉽지 않고, 법이 디지털 성범죄 수법을 따라가지 못하는 점도 있고, 다른 한편, '딥페이크'를 '재미'로 소비하는 것도 문제입니다.

스마트폰 하나만으로도 가능하거든요. 요즘은?

특히, 10대 청소년의 경우 타인의 얼굴을 합성하는 행위를 장난으로 생각해 처벌받지 않는다고 생각한다는 조사 결과도 있습니다.

'가짜인 걸 알고 보는데 뭐가 문제가 되냐' 이런 인식인데, 새로운 기술의 도입은 그러나 언제나 그랬듯, 이번에도 범죄자들에겐 좋은 도구가 된다는 점 잊지 말아야 합니다.

[앵커]

'딥페이크' 물론 잘 활용하면 좋은 기술입니다.

영화나 엔터테인먼트 산업에서 실제로 그렇고, 또 그리운 사람의 모습을 똑같이 재현해서 감동을 주기도 합니다.

모쪼록 잘 관리해서 좋은 쪽으로만 발전해가길 기대해봅니다.

잘 들었습니다.

-

-

서영민 기자 seo0177@gmail.com

서영민 기자의 기사 모음

-

이 기사가 좋으셨다면

-

좋아요

0

-

응원해요

0

-

후속 원해요

0

![[ET] “한 사람에 한 통만” 타이레놀 품귀에 판매 제한까지?](https://news.kbs.co.kr/data/news/title_image/newsmp4/economy_time/2021/05/31/30_5197993.jpg)

![[ET] 5월 31일 ‘바다의 날’…몸살 앓는 우리 바다](https://news.kbs.co.kr/data/news/title_image/newsmp4/economy_time/2021/05/31/50_5197995.jpg)

이 기사에 대한 의견을 남겨주세요.