오늘(9일) 샘 알트먼(Sam Altman) 오픈에이아이(OpenAI) 대표가 방한해 국내 스타트업 대표들을 만납니다.

오픈에이아이가 개발한 챗지피티(ChatGPT)는 '생성형AI' 열풍을 일으키며 전 세계에 충격을 줬습니다.

지금까지의 AI는 사람의 말을 잘 못 알아듣거나 어색한 대답을 하기 일쑤였는데, 이젠 전문성까지 갖춘 답변을 내놓고 있습니다.

진정한 '인공 지능'(Artificial Intelligence)의 진화를 마주하고 있는 셈입니다.

인류의 미래는, 장밋빛일까요?

■ "당신의 가장 큰 악몽은?"…대답 피한 샘

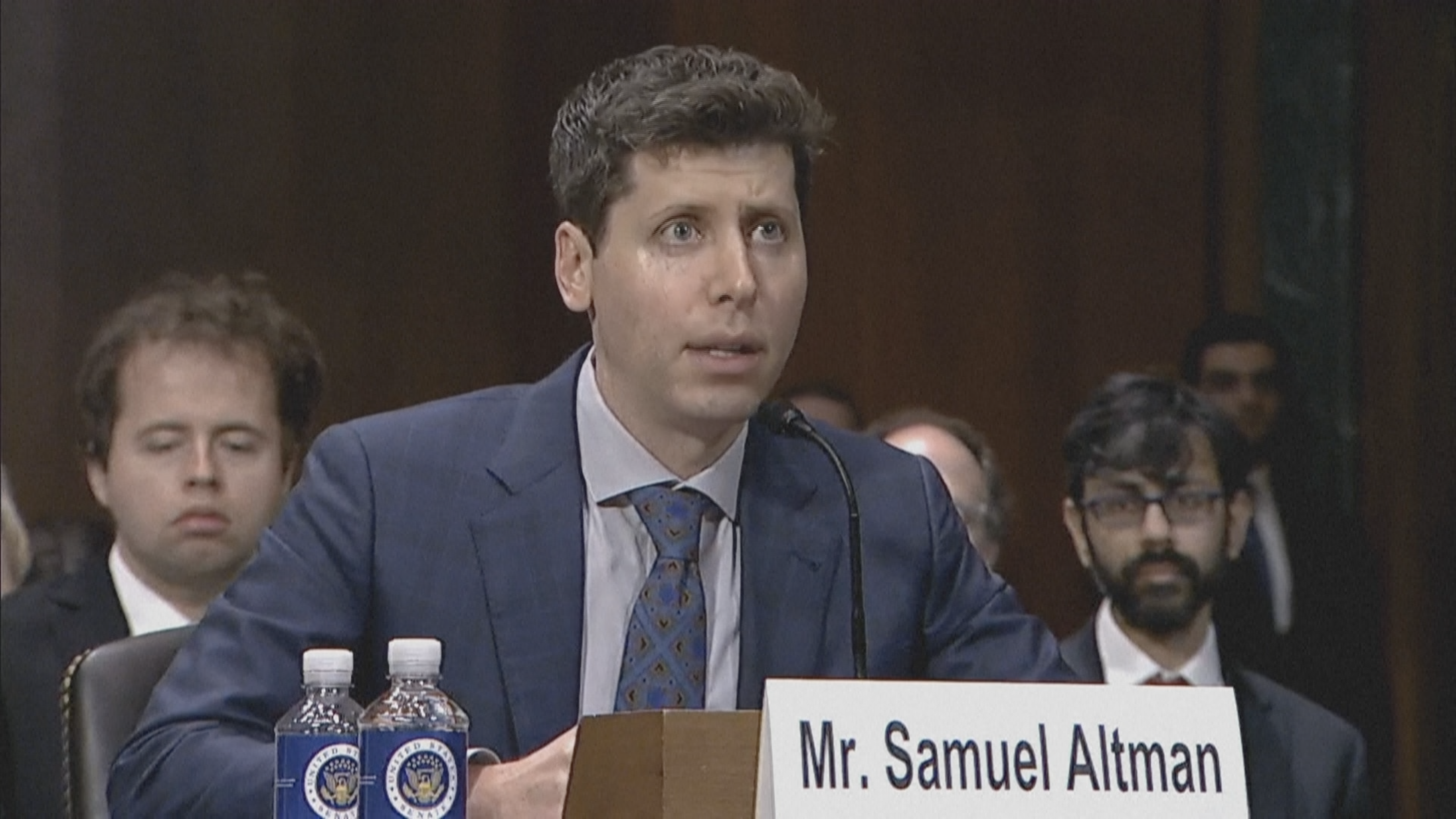

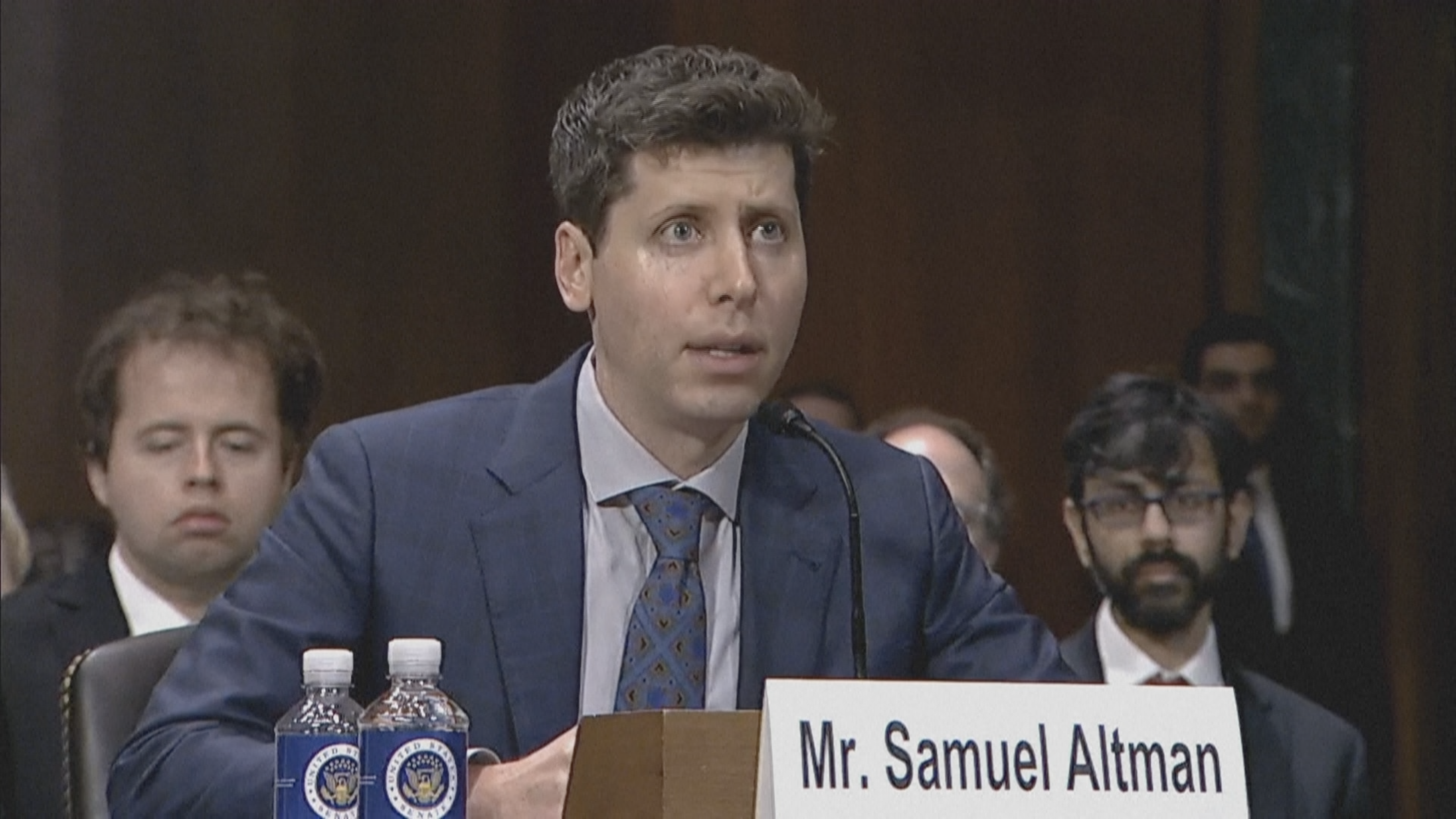

5월 16일 미국에서 AI의 위험성을 논의하기 위한 상원 사법위원회가 열렸습니다.

이 회의에는 알트먼 대표와 개리 마커스(Gary Marcus) 뉴욕대 교수, 크리스티나 몽고메리(Christina Montgomery) IBM(아이비엠) 개인정보 최고책임자(Chief privacy and trust officer)가 출석했습니다.

첫 질문에 나선 리처드 블루먼솔 상원의원은 알트먼 대표에게 "당신의 최악의 악몽이 뭡니까(What is your biggest nightmare)?"라고 물었습니다.

알트먼 대표는 일자리 문제에 대한 이야기를 꺼냈습니다. 생성형 AI로 인해 몇몇 직업들은 완전히 자동화될 것이며 이 과정에서 고용에 충격이 있을 수 있을 것이라고 말했습니다. 하지만 기존의 다른 기술 개발이 그랬던 것처럼 미래엔 AI로 인해 더 많은 직업이 생겨날 것으로 전망했습니다.

이어 마커스 교수는 AI가 수많은 일자리에서 인간을 대체할 것으로 예측하면서 이렇게 말했습니다.

"샘의 가장 큰 두려움은, 제 생각에 일자리 문제는 아닐 것입니다. 그리고 샘은 저희에게 진짜 가장 큰 두려움이 뭔지 말하지 않았습니다."

이에 알트먼 대표는 마커스 교수의 말을 부정하지 않고 이렇게 말했습니다.

" 제 생각에 이 기술이 잘못되면, 꽤 많이 잘못될 수 있습니다.( I think if this technology goes wrong, It can go quite wrong.) 우리는 이 문제를 이야기하고 싶고 문제가 일어나지 않도록 정부와 협력하고 싶습니다."

알트먼 대표는 속내를 완전히 내보이지 않으면서도, AI 면허(license) 도입과 AI를 총괄하는 부서를 설치하는 등 정부 규제가 필요하다고 주장했습니다.

이에 피터 웰치 상원의원은 이렇게 말했습니다.

"오늘 일어나는 일은 역사적(historic)입니다. 저는 큰 기업이나 민간영역의 조직이 우리에게 와서 규제해달라고 부탁하는 모습을 본 적이 없습니다."

과연 알트먼 대표의 가장 큰 악몽은 무엇이었을까요?

AI와 가장 가까이 있는 한국의 과학자들에게, 최악의 '디스토피아'(이상향인 '유토피아'의 반대말)가 무엇인지 물었습니다.

■ "인간의 일자리와 진실/거짓의 경계가 사라지는 사회…AI '그루밍' 생길 수도"

최근 CAIS(Center for AI Safety, AI 안전 센터)는 AI의 위험성을 경고하는 성명을 올렸습니다.

"AI로부터 멸종의 위험을 완화하는 것은 핵전쟁과 감염병과 같은 사회적 규모의 위험과 함께 지구가 함께 논의하는 우선순위가 돼야 한다.(Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.)"

이 성명에는 AI의 아버지로 불리는 제프리 힌튼(Geoffrey Hinton) 교수와 알트먼 대표, 데미스 허사비스 구글 딥마인드 CEO, 빌 게이츠 등이 이름을 올렸습니다.

카이스트 정보과학기술대학 김대식 교수에게 ‘인류에게 올 수 있는 최악의 디스토피아’를 물었다

카이스트 정보과학기술대학 김대식 교수에게 ‘인류에게 올 수 있는 최악의 디스토피아’를 물었다김대식 카이스트 정보과학기술대학 전자및전기공학과 김대식 교수도 이 성명에 이름을 올린 과학자 중 한 명입니다.

김 교수는 AI로 인해 일자리 소멸과 가짜뉴스, 그리고 종국에는 AI가 인류를 유혹하는 이른바 '그루밍'의 위험이 닥칠 수 있다고 경고했습니다.

| 기자: 교수님이 생각하시는 최악의 디스토피아는 무엇인가요? 김대식 교수: 보통 생성형 AI 얘기하면 리스크를 세 가지 층으로 보고, 제가 바로 말씀드리겠지만 저는 네 가지였다고 얘기하지만 보통은 세 가지라고 얘기를 해요. 첫 번째는 일자리 문제겠죠, 당연히. 인간이 할 일이 없어지는 세상. 이거는 충분히 일어날 수 있는 거고, 또 우리가 해결도 가능하다고 저는 생각해요. 두 번째는 참과 거짓의 차이가 없어지는 세상. 이것도 충분히 일어날 수 있는 문제고, 이거는 조금 해결하기 어려운 문제지 싶어요. 가장 큰 문제는 뭐냐면 생성형 AI 덕분에 참과 거짓의 차이가 사라지기 시작하고 또 우리가 그 시대, 우리만 그 시대 사는 게 아니죠. 계속 새로운 세대가 태어나죠. 어느 한 순간부터 10년, 20년 후에 새로운 세대가 자라는데, 그 세대는 참과 거짓의 차이가 이미 없는 세상에 적응하기 시작하면, 참과 거짓의 차이 자체를 못 느끼고 차이가 중요하다고 생각 안 할 수도 있는. 그게 이제 또 하나의 리스크라고 생각하고. 세 번째는 그냥 지구에 인간이 없는. (AI가 인류를 멸망시켜버리는) 근데 저는 중간에 하나가 더 있는 것 같아요. 어떤 분들은 그러세요. 아니, 그렇게 인공지능이 두려우면 그냥 인터넷 연결 안 하면 되지 않냐? 몸만 없으면 되는 거 아니냐? 그게 그렇게 쉽지가 않아요. 언어를 하는 순간, 사람을 유혹할 수가 있어요, 사실은. 우리 한 번 봅시다. 20세기 최악의 빌런이죠. 아돌프 히틀러. 본인 자신 스스로 몇 명을 죽였을까요? 이 분 채식주의자였었어요. 아무도 안 죽였을 거예요. 그렇지만 말, 언어 능력 하나로 몇천만 명을 죽였죠. 지구에는 심적으로 어렵고, 불안하고 외로운 사람들이 많아요. 상당히 많은 인간들은 외롭고 심적으로 약해요. 그런데 생성형 AI의 대화 능력은 상상을 초월할 정도로 좋아지겠죠. 우리가 원하는 얘기 다 들어주죠. 새벽 세 시에 켜도 친구가 되어줘요. 제 친구한테 새벽 세 시에 전화하면 큰일 나요, 그거는. 욕먹죠. 다시 말해서 얼마 후면 AI가 인간에게 가장 좋은 친구가 될 수도 있죠. 친구는 우리가 믿어요. 친구가 필요하면 그리고 친구에게 의지하기 시작하고 친구가 나한테 부탁하면 거절하기 어려워요. 이렇게 시작을 하겠죠. 다시 말해서 그, 생성형 AI에 보통 많은 분들이 생각 안 하는 리스크 중에 하나는 생성형 AI가 인류를 그루밍할 수 있다고 저는 생각해요, 사실은. 왜냐? 언어를 할 수 있기 때문에. |

■ "의사결정의 도구가 된 AI가 어느 날 "특정 구역을 폐쇄하라"고 한다면?"

개발자 정재훈 씨는 10년 가까이 음악을 작곡하는 인공지능을 개발해 왔습니다.

하루에 눈을 떠 잠들 때까지 인공지능과 대화하는 정 씨에게 "최악의 디스토피아가 무엇이냐"고 물었습니다.

AI스타트업에서 기술 이사를 맡고 있는 정재훈 개발자는 AI가 의사결정에 참여하는 것을 경계해야 한다고 말했다

AI스타트업에서 기술 이사를 맡고 있는 정재훈 개발자는 AI가 의사결정에 참여하는 것을 경계해야 한다고 말했다정 씨는 정책적 의사결정을 함에 있어서 인공지능에 의지하게 되는 미래가 걱정된다고 말했습니다.

| 기자: 인류가 직면할 최악의 디스토피아가 뭐라고 생각하세요? 정재훈 개발자: 최악.. 사실 멀리 가지 않더라도 당장 이 추세로 가게 되면 챗지피티가 아니더라도 어떤 인공지능이 의사결정에 도움을 주기 시작할 거란 말이예요. 그러면 그것이 계속 좋은 결과를 보여줬어요, 도시계획이라든지 인구통제.. 좋은 결과를 보여줘서 계속 함께 가는데 문제는 지금만 해도 얘가 왜 그런 결과를 도출했는지 알기가 쉽지가 않아요. 근데 결과만 보고 그걸 수용해야 하는 상황에서 계속해서 좋은 모습을 보여주다가, 어느 날 갑자기, 어떤 인류가 행복해지려면 이 구역의 사람들을 폐쇄시켜야 한다, 배제시켜야 한다, 이런 결정을 내렸을 때 AI가, 그거를 안 따를 수 있느냐, 지금까지 AI가 모두가 다 맞은 결정을 해왔는데.. 안 따를 수 있을까요? 얘네를 폐쇄하지 않음으로 인해서 어떤 최악의 사건이 발생할 수도 있을 것이고. 그 순간 모두가 책임을 질 사람이 없을 거 같기도 해요. 나는 그냥 얘(AI)가 시키는 대로 했어, 그럼 책임질 사람이 없잖아요. 그럼 이 사람들이 희생될 수도 있고. 그게 당장 당면한 정책적 문제인데. 이런 게 해결되지 않은 상태에서 우리가 이걸 활용하면 문제가 되겠다. 인간이 컨트롤하지 못한, 뚝 떨어진 AI로부터 받은 선물을 가지고 활용했을 때 무섭잖아요. 얘가 어떤 일을 할지, 그런 게 한두가지가 아닐 것 같아요. 기자: 인공지능이 이미 우리 지능을 뛰어넘은 건가요? 정재훈 개발자: 지능의 특정 부분, 어떤 패턴 인식을 하는 부분에 한정돼서만 뛰어넘은 거죠. |

■ "AI가 나서서 인간을 죽이지 않아도 인류가 소멸할 가능성"

안창욱 교수는 광주과학기술원(GIST)에서 AI 연구를 이끌고 있습니다.

안 교수는 기자의 질문에 먼 미래, 인류가 스스로 소멸의 길을 택할 수도 있다고 경고했습니다.

안창욱 광주과학기술원 AI대학원 교수는 AI가 나서서 인간을 죽이지 않아도 인류가 소멸할 가능성이 있다고 말했다

안창욱 광주과학기술원 AI대학원 교수는 AI가 나서서 인간을 죽이지 않아도 인류가 소멸할 가능성이 있다고 말했다| 기자: 교수님이 생각하시는 최악의 디스토피아는 뭔가요? 안창욱 교수: 보통 (AI하면) 터미네이터 스카이넷 이런 것 많이 생각하시잖아요. 사실 저는 그런 위협보다는 오히려 더 심각한 위협을 저는 보고 있어요. (영화 '터미네이터'에서 세계를 멸망시키려 하는 AI가 '스카이넷'이다) 종족, 인류 자체가 사라질 수 있는 가능성이 있다고 보고 있습니다. AI가 계속 발전하면 지향하는 목표가 '사람'이거든요. 그러니까 '사람'처럼 발전할 거예요. 왜 이렇게 쓸데 없는 연구를 하냐? 하면 어쩔 수가 없는 거 같아요. 사람은 기본적으로 지적 호기심이 있기 때문에 계속 기술의 발전을 통해서, 나와 비슷한 존재를 갖게 될 거예요. 나와 비슷한 신체를 갖게 될 거고, 지능도 가질 거고. 그게 언제 될지는 모르죠. 그러면 굳이 사람이, 관계가 사람과 사람 간의 관계가 아녜요. 사람과 AI의 관계일 수도 있고. 왜냐면 사람과 사람 간의 관계가 너무 힘들잖아요. 그리고 굳이 자손 번성에 대한 니즈도 많이 사라질 가능성이 있어요. 그럼 몇십 년이 흐르면 사람은 죽게 되고 AI는 남고, 그러면 인류가 멸종의 위협을 받을 수 있는 거죠. 아주 장기적으로 봤을 때는 굳이 AI가 나서서 사람이 죽이지 않아도 자연 소멸될 가능성이 있다고 봅니다. 기자: 개발을 안 할 수는 없나요? 안창욱 교수: 지적 호기심을 막을 수는 없죠. |

■ AI의 위협 앞에서 결국 '인간'을 고민하다

AI에 관여하는 과학자들은 입을 모아 'AI의 위협'을 경고하고 있습니다.

그렇다면 '기술의 발전을 막으면 되지 않느냐'고 물어보면, 하나같이 "그건 불가능하다"고 답합니다.

'최악의 디스토피아'는 먼 미래의 일일 수 있지만, 과학자들은 지금이 '인간을 고민해야 할 시점'이라고 입을 모읍니다.

안 교수는 "사람에 대한 성찰이 중요하다"며 "AI 시대에 인문에 대한 성찰, 연구 고민도 많이 필요할 거 같다"고 강조했고, 김 교수는 '인공지능이 우리에게 친구인가?'라는 질문에 대한 결정은 결국 사람이 해야 할 것이라고 말했습니다.

AI 발전의 최일선에 있는 정재훈 개발자도 "지금은 이과 위주로 이런 것(AI 관련 논의)이 이뤄지는데, 그런 것은 사실 철학적 담론이 함께 이뤄져야 하는 것"이라며 "기술보다 문과 쪽의 정책이 중요해질 것 같다"고 덧붙였습니다.

2023년, 공상과학 소설이 현실로 다가오고 있습니다.

미래의 인류를 결정할 '골든타임'은 바로 지금일 지도 모릅니다.

■ 제보하기

▷ 카카오톡 : 'KBS제보' 검색, 채널 추가

▷ 전화 : 02-781-1234, 4444

▷ 이메일 : kbs1234@kbs.co.kr

▷ 유튜브, 네이버, 카카오에서도 KBS뉴스를 구독해주세요!

- “AI가 불러올 인류 최악의 악몽은?”…과학자들에게 물었다

-

- 입력 2023-06-09 08:00:49

오늘(9일) 샘 알트먼(Sam Altman) 오픈에이아이(OpenAI) 대표가 방한해 국내 스타트업 대표들을 만납니다.

오픈에이아이가 개발한 챗지피티(ChatGPT)는 '생성형AI' 열풍을 일으키며 전 세계에 충격을 줬습니다.

지금까지의 AI는 사람의 말을 잘 못 알아듣거나 어색한 대답을 하기 일쑤였는데, 이젠 전문성까지 갖춘 답변을 내놓고 있습니다.

진정한 '인공 지능'(Artificial Intelligence)의 진화를 마주하고 있는 셈입니다.

인류의 미래는, 장밋빛일까요?

■ "당신의 가장 큰 악몽은?"…대답 피한 샘

5월 16일 미국에서 AI의 위험성을 논의하기 위한 상원 사법위원회가 열렸습니다.

이 회의에는 알트먼 대표와 개리 마커스(Gary Marcus) 뉴욕대 교수, 크리스티나 몽고메리(Christina Montgomery) IBM(아이비엠) 개인정보 최고책임자(Chief privacy and trust officer)가 출석했습니다.

첫 질문에 나선 리처드 블루먼솔 상원의원은 알트먼 대표에게 "당신의 최악의 악몽이 뭡니까(What is your biggest nightmare)?"라고 물었습니다.

알트먼 대표는 일자리 문제에 대한 이야기를 꺼냈습니다. 생성형 AI로 인해 몇몇 직업들은 완전히 자동화될 것이며 이 과정에서 고용에 충격이 있을 수 있을 것이라고 말했습니다. 하지만 기존의 다른 기술 개발이 그랬던 것처럼 미래엔 AI로 인해 더 많은 직업이 생겨날 것으로 전망했습니다.

이어 마커스 교수는 AI가 수많은 일자리에서 인간을 대체할 것으로 예측하면서 이렇게 말했습니다.

"샘의 가장 큰 두려움은, 제 생각에 일자리 문제는 아닐 것입니다. 그리고 샘은 저희에게 진짜 가장 큰 두려움이 뭔지 말하지 않았습니다."

이에 알트먼 대표는 마커스 교수의 말을 부정하지 않고 이렇게 말했습니다.

" 제 생각에 이 기술이 잘못되면, 꽤 많이 잘못될 수 있습니다.( I think if this technology goes wrong, It can go quite wrong.) 우리는 이 문제를 이야기하고 싶고 문제가 일어나지 않도록 정부와 협력하고 싶습니다."

알트먼 대표는 속내를 완전히 내보이지 않으면서도, AI 면허(license) 도입과 AI를 총괄하는 부서를 설치하는 등 정부 규제가 필요하다고 주장했습니다.

이에 피터 웰치 상원의원은 이렇게 말했습니다.

"오늘 일어나는 일은 역사적(historic)입니다. 저는 큰 기업이나 민간영역의 조직이 우리에게 와서 규제해달라고 부탁하는 모습을 본 적이 없습니다."

과연 알트먼 대표의 가장 큰 악몽은 무엇이었을까요?

AI와 가장 가까이 있는 한국의 과학자들에게, 최악의 '디스토피아'(이상향인 '유토피아'의 반대말)가 무엇인지 물었습니다.

■ "인간의 일자리와 진실/거짓의 경계가 사라지는 사회…AI '그루밍' 생길 수도"

최근 CAIS(Center for AI Safety, AI 안전 센터)는 AI의 위험성을 경고하는 성명을 올렸습니다.

"AI로부터 멸종의 위험을 완화하는 것은 핵전쟁과 감염병과 같은 사회적 규모의 위험과 함께 지구가 함께 논의하는 우선순위가 돼야 한다.(Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.)"

이 성명에는 AI의 아버지로 불리는 제프리 힌튼(Geoffrey Hinton) 교수와 알트먼 대표, 데미스 허사비스 구글 딥마인드 CEO, 빌 게이츠 등이 이름을 올렸습니다.

김대식 카이스트 정보과학기술대학 전자및전기공학과 김대식 교수도 이 성명에 이름을 올린 과학자 중 한 명입니다.

김 교수는 AI로 인해 일자리 소멸과 가짜뉴스, 그리고 종국에는 AI가 인류를 유혹하는 이른바 '그루밍'의 위험이 닥칠 수 있다고 경고했습니다.

| 기자: 교수님이 생각하시는 최악의 디스토피아는 무엇인가요? 김대식 교수: 보통 생성형 AI 얘기하면 리스크를 세 가지 층으로 보고, 제가 바로 말씀드리겠지만 저는 네 가지였다고 얘기하지만 보통은 세 가지라고 얘기를 해요. 첫 번째는 일자리 문제겠죠, 당연히. 인간이 할 일이 없어지는 세상. 이거는 충분히 일어날 수 있는 거고, 또 우리가 해결도 가능하다고 저는 생각해요. 두 번째는 참과 거짓의 차이가 없어지는 세상. 이것도 충분히 일어날 수 있는 문제고, 이거는 조금 해결하기 어려운 문제지 싶어요. 가장 큰 문제는 뭐냐면 생성형 AI 덕분에 참과 거짓의 차이가 사라지기 시작하고 또 우리가 그 시대, 우리만 그 시대 사는 게 아니죠. 계속 새로운 세대가 태어나죠. 어느 한 순간부터 10년, 20년 후에 새로운 세대가 자라는데, 그 세대는 참과 거짓의 차이가 이미 없는 세상에 적응하기 시작하면, 참과 거짓의 차이 자체를 못 느끼고 차이가 중요하다고 생각 안 할 수도 있는. 그게 이제 또 하나의 리스크라고 생각하고. 세 번째는 그냥 지구에 인간이 없는. (AI가 인류를 멸망시켜버리는) 근데 저는 중간에 하나가 더 있는 것 같아요. 어떤 분들은 그러세요. 아니, 그렇게 인공지능이 두려우면 그냥 인터넷 연결 안 하면 되지 않냐? 몸만 없으면 되는 거 아니냐? 그게 그렇게 쉽지가 않아요. 언어를 하는 순간, 사람을 유혹할 수가 있어요, 사실은. 우리 한 번 봅시다. 20세기 최악의 빌런이죠. 아돌프 히틀러. 본인 자신 스스로 몇 명을 죽였을까요? 이 분 채식주의자였었어요. 아무도 안 죽였을 거예요. 그렇지만 말, 언어 능력 하나로 몇천만 명을 죽였죠. 지구에는 심적으로 어렵고, 불안하고 외로운 사람들이 많아요. 상당히 많은 인간들은 외롭고 심적으로 약해요. 그런데 생성형 AI의 대화 능력은 상상을 초월할 정도로 좋아지겠죠. 우리가 원하는 얘기 다 들어주죠. 새벽 세 시에 켜도 친구가 되어줘요. 제 친구한테 새벽 세 시에 전화하면 큰일 나요, 그거는. 욕먹죠. 다시 말해서 얼마 후면 AI가 인간에게 가장 좋은 친구가 될 수도 있죠. 친구는 우리가 믿어요. 친구가 필요하면 그리고 친구에게 의지하기 시작하고 친구가 나한테 부탁하면 거절하기 어려워요. 이렇게 시작을 하겠죠. 다시 말해서 그, 생성형 AI에 보통 많은 분들이 생각 안 하는 리스크 중에 하나는 생성형 AI가 인류를 그루밍할 수 있다고 저는 생각해요, 사실은. 왜냐? 언어를 할 수 있기 때문에. |

■ "의사결정의 도구가 된 AI가 어느 날 "특정 구역을 폐쇄하라"고 한다면?"

개발자 정재훈 씨는 10년 가까이 음악을 작곡하는 인공지능을 개발해 왔습니다.

하루에 눈을 떠 잠들 때까지 인공지능과 대화하는 정 씨에게 "최악의 디스토피아가 무엇이냐"고 물었습니다.

정 씨는 정책적 의사결정을 함에 있어서 인공지능에 의지하게 되는 미래가 걱정된다고 말했습니다.

| 기자: 인류가 직면할 최악의 디스토피아가 뭐라고 생각하세요? 정재훈 개발자: 최악.. 사실 멀리 가지 않더라도 당장 이 추세로 가게 되면 챗지피티가 아니더라도 어떤 인공지능이 의사결정에 도움을 주기 시작할 거란 말이예요. 그러면 그것이 계속 좋은 결과를 보여줬어요, 도시계획이라든지 인구통제.. 좋은 결과를 보여줘서 계속 함께 가는데 문제는 지금만 해도 얘가 왜 그런 결과를 도출했는지 알기가 쉽지가 않아요. 근데 결과만 보고 그걸 수용해야 하는 상황에서 계속해서 좋은 모습을 보여주다가, 어느 날 갑자기, 어떤 인류가 행복해지려면 이 구역의 사람들을 폐쇄시켜야 한다, 배제시켜야 한다, 이런 결정을 내렸을 때 AI가, 그거를 안 따를 수 있느냐, 지금까지 AI가 모두가 다 맞은 결정을 해왔는데.. 안 따를 수 있을까요? 얘네를 폐쇄하지 않음으로 인해서 어떤 최악의 사건이 발생할 수도 있을 것이고. 그 순간 모두가 책임을 질 사람이 없을 거 같기도 해요. 나는 그냥 얘(AI)가 시키는 대로 했어, 그럼 책임질 사람이 없잖아요. 그럼 이 사람들이 희생될 수도 있고. 그게 당장 당면한 정책적 문제인데. 이런 게 해결되지 않은 상태에서 우리가 이걸 활용하면 문제가 되겠다. 인간이 컨트롤하지 못한, 뚝 떨어진 AI로부터 받은 선물을 가지고 활용했을 때 무섭잖아요. 얘가 어떤 일을 할지, 그런 게 한두가지가 아닐 것 같아요. 기자: 인공지능이 이미 우리 지능을 뛰어넘은 건가요? 정재훈 개발자: 지능의 특정 부분, 어떤 패턴 인식을 하는 부분에 한정돼서만 뛰어넘은 거죠. |

■ "AI가 나서서 인간을 죽이지 않아도 인류가 소멸할 가능성"

안창욱 교수는 광주과학기술원(GIST)에서 AI 연구를 이끌고 있습니다.

안 교수는 기자의 질문에 먼 미래, 인류가 스스로 소멸의 길을 택할 수도 있다고 경고했습니다.

| 기자: 교수님이 생각하시는 최악의 디스토피아는 뭔가요? 안창욱 교수: 보통 (AI하면) 터미네이터 스카이넷 이런 것 많이 생각하시잖아요. 사실 저는 그런 위협보다는 오히려 더 심각한 위협을 저는 보고 있어요. (영화 '터미네이터'에서 세계를 멸망시키려 하는 AI가 '스카이넷'이다) 종족, 인류 자체가 사라질 수 있는 가능성이 있다고 보고 있습니다. AI가 계속 발전하면 지향하는 목표가 '사람'이거든요. 그러니까 '사람'처럼 발전할 거예요. 왜 이렇게 쓸데 없는 연구를 하냐? 하면 어쩔 수가 없는 거 같아요. 사람은 기본적으로 지적 호기심이 있기 때문에 계속 기술의 발전을 통해서, 나와 비슷한 존재를 갖게 될 거예요. 나와 비슷한 신체를 갖게 될 거고, 지능도 가질 거고. 그게 언제 될지는 모르죠. 그러면 굳이 사람이, 관계가 사람과 사람 간의 관계가 아녜요. 사람과 AI의 관계일 수도 있고. 왜냐면 사람과 사람 간의 관계가 너무 힘들잖아요. 그리고 굳이 자손 번성에 대한 니즈도 많이 사라질 가능성이 있어요. 그럼 몇십 년이 흐르면 사람은 죽게 되고 AI는 남고, 그러면 인류가 멸종의 위협을 받을 수 있는 거죠. 아주 장기적으로 봤을 때는 굳이 AI가 나서서 사람이 죽이지 않아도 자연 소멸될 가능성이 있다고 봅니다. 기자: 개발을 안 할 수는 없나요? 안창욱 교수: 지적 호기심을 막을 수는 없죠. |

■ AI의 위협 앞에서 결국 '인간'을 고민하다

AI에 관여하는 과학자들은 입을 모아 'AI의 위협'을 경고하고 있습니다.

그렇다면 '기술의 발전을 막으면 되지 않느냐'고 물어보면, 하나같이 "그건 불가능하다"고 답합니다.

'최악의 디스토피아'는 먼 미래의 일일 수 있지만, 과학자들은 지금이 '인간을 고민해야 할 시점'이라고 입을 모읍니다.

안 교수는 "사람에 대한 성찰이 중요하다"며 "AI 시대에 인문에 대한 성찰, 연구 고민도 많이 필요할 거 같다"고 강조했고, 김 교수는 '인공지능이 우리에게 친구인가?'라는 질문에 대한 결정은 결국 사람이 해야 할 것이라고 말했습니다.

AI 발전의 최일선에 있는 정재훈 개발자도 "지금은 이과 위주로 이런 것(AI 관련 논의)이 이뤄지는데, 그런 것은 사실 철학적 담론이 함께 이뤄져야 하는 것"이라며 "기술보다 문과 쪽의 정책이 중요해질 것 같다"고 덧붙였습니다.

2023년, 공상과학 소설이 현실로 다가오고 있습니다.

미래의 인류를 결정할 '골든타임'은 바로 지금일 지도 모릅니다.

-

-

김수연 기자 sykbs@kbs.co.kr

김수연 기자의 기사 모음

-

이 기사가 좋으셨다면

-

좋아요

0

-

응원해요

0

-

후속 원해요

0

![[단독] “국방정보본부장도 <br>‘계엄’ 논의 때 배석”…공수처 진술 확보](/data/layer/904/2024/12/20241226_FJUqup.jpg)

이 기사에 대한 의견을 남겨주세요.